Inteligência artificial: Com o que precisamos nos preocupar? (VOL. 8, N. 1, 2017)

Quais são os problemas mais iminentes que podem decorrer do desenvolvimento da inteligência artificial?

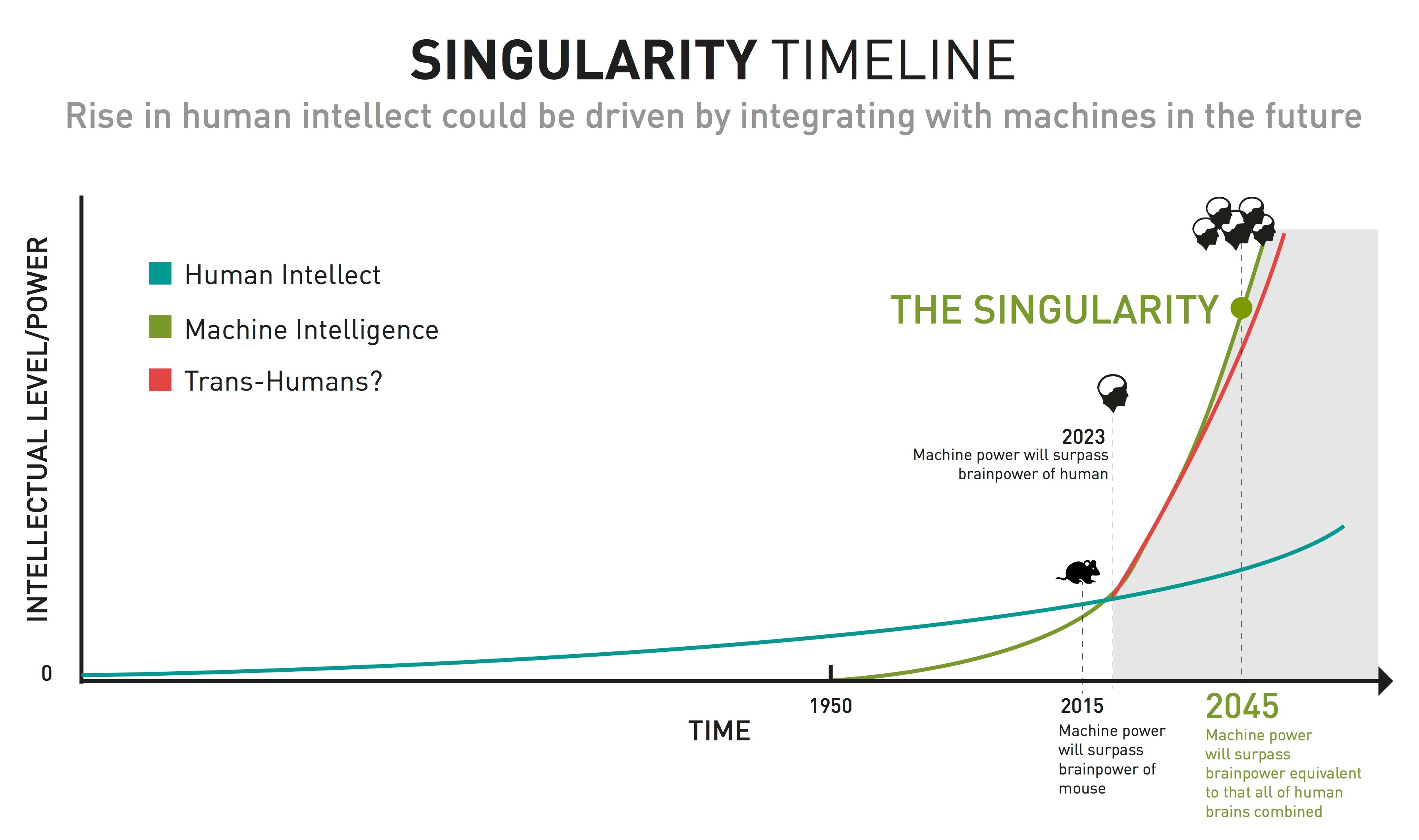

Em 1993, o cientista da computação e escritor Vernor Vinge cunhou o termo “singularidade tecnológica“. Esse conceito se refere ao momento em que a inteligência artificial estará tão desenvolvida que os computadores superarão os próprios seres humanos e, a partir desse momento, será impossível prever o que poderá acontecer à nossa espécie.

Segundo Vinge, o evento é iminente, deve acontecer antes de 2030, e isso transformará radicalmente o mundo que conhecemos hoje. Kurzweil, um famoso inventor e futurista que vê a singularidade com mais otimismo que Vinge, acredita que seremos capazes de fazer um “upload” da nossa consciência (ou transferir uma cópia dela) para uma máquina super-humana e, com isso, vivermos para sempre.

A lógica por trás dos argumentos à favor da iminência da singularidade é fácil de compreender: se trata de uma simples extrapolação.

Essa imagem mostra o crescimento do intelecto do homem ao longo dos anos (linha azul) e o crescimento da inteligência artificial das máquinas (linha verde). Usando uma série de modelos e dados históricos, Kurzweil calculou que em 2023 a inteligência artificial vai ultrapassar a capacidade cerebral de um ser humano. A partir desse ponto, teorias sugerem o desenvolvimento do trans-humanismo (linha vermelha). Os trans-humanos serão como androides (parte homem, parte máquina), numa relação simbiótica que pegará o melhor dos dois para produzir uma super-espécie. Através de jogos de xadrez, essa combinação já se provou mais eficiente do que um humano ou uma máquina sozinhos. No ano de 2045, calculado também por Kurzweil, as máquinas irão superar a capacidade cerebral equivalente à de todos os seres humanos juntos. E não haverá humano ou trans-humano que alcance a inteligência da máquina.

O que acontecerá se (ou quando) atingirmos a singularidade?

Por ser algo extremamente especulativo (e sem nenhuma evidência concreta de que pode acontecer nas próximas décadas) é difícil dizer qualquer coisa.

Mas se, de fato, os computadores se tornarem mais inteligentes que os próprios seres humanos, não terão muita dificuldade para perceber que a existência da raça humana não traz nenhum benefício para o planeta, nem para a “raça dos robôs”.

O que seria, então, de nós? Seríamos subjugados pelas máquinas? Conviveríamos em paz com elas? Teríamos uma sociedade mista onde humanos e robôs dividem o mesmo espaço, os mesmos empregos? Teríamos mentes humanas trabalhando na ciência, ao lado de robôs muito mais inteligentes, eficientes e precisos?

Não à toa, o escritor de ficção científica Isaac Asimov enunciou as suas famosas “3 leis da robótica“:

1) Um robô não pode ferir um humano ou permitir que um humano sofra algum mal;

2) Os robôs devem obedecer às ordens dos humanos, exceto nos casos em que tais ordens entrem em conflito com a primeira lei;

3) Um robô deve proteger sua própria existência, desde que não entre em conflito com as leis anteriores.

Eu, Robô – Isaac Asimov, 1950.

Essas leis deixaram de ser mera ficção científica e se tornaram quase um marco ético, respeitado por muitos pesquisadores em inteligência artificial.

A questão é: Será que a inteligência robótica será capaz de superar esse determinismo algorítmico (esse determinismo do código computacional que o gerou)? E é exatamente nesse ponto que está a preocupação de muitos cientistas com a Singularidade. O que acontece se perdemos o controle?

Quanto devemos nos preocupar com a singularidade?

Apesar de Vinge ter feito sua previsão ainda na década de 90, podemos considerá-la muito otimista com relação ao progresso no campo da inteligência artificial. Mesmo a de Kurtzweil ainda não me parece tão realista.

O co-fundador da Microsoft, Paul Allen, publicou um texto no MIT Technology Review elencando uma série de argumentos contrários a essa chegada próxima da singularidade. Um dos seus apontamentos é que essa extrapolação do desenvolvimento tecnológico do Kurzweil não leva em conta a necessidade de desenvolvimento também na área da cognição humana, que está longe de chegar à mesma taxa de desenvolvimento da computação em geral. Além disso, a história da ciência mostra que o avanço tecnológico não caminha com ritmo constante e numa linha reta, muito menos numa eterna curva exponencial.

O progresso científico é extremamente irregular, imprevisível, às vezes até movido por acasos e erros.

John Storrs Hall, em seu livro “Além da inteligência artificial: criando a consciência da máquina”, defende que não precisamos temer a presença robótica na nossa civilização, porque nós humanos somos muito piores do que qualquer robô no quesito ético. Ele diz que “nós sempre iremos mentir, enganar, roubar e atirar primeiro”. Enquanto os robôs iriam confiar uns nos outros e cooperar entre si, os seres humanos “iriam discutir, brigar e apunhalar uns aos outros pelas costas”. E é por isso, ele completa, que “robôs seriam moralmente melhores do que nós”.

Mesmo apostando mais no posicionamento de Allen, contrário à ideia da singularidade (ou ao menos de sua proximidade), é preciso dizer que esse pressuposto – relativo à moral dos robôs – não me parece ter um embasamento muito forte.

- No caso dos robôs não possuírem uma inteligência sobre-humana nem autonomia para “pensar” não faz sentido dizer que eles possuem uma moral própria. Suas ações ainda estão sujeitas ao determinismo do código que as gerou. Mesmo os robôs que já conseguem “aprender” algumas informações e que possuem uma mínima liberdade de ação, moral pressupõe alguma parcela de livre-arbítrio.

- Se os robôs do futuro possuírem essa inteligência autômata, autônoma e sobre-humana o que garante que eles terão uma moral “superior à nossa”. A própria valoração do que é uma moral melhor ou pior, ou o que é Bem e Mal, não são critérios absolutos. Se os robôs entenderem que um comportamento de Bem é proteger o planeta Terra a todo custo, dizimar a espécie humana para atingir esse fim com mais rapidez pode ser uma atitude moral para os robôs.

Problemas mais urgentes da inteligência artificial

Apesar de muitos se preocuparem com a iminência de uma era de singularidade (ou da destruição da raça humana pelas máquinas) essa está longe de ser o problema mais grave e imediato da inteligência artificial. Existem pelo menos três outros problemas que devem ser discutidos com muito mais urgência:

1) Redução da nossa liberdade de escolha

Como já discutimos no post “A anarquia na internet – quanto estamos pagando por mais eficiência?“, a inteligência artificial tem sido usada largamente para traçar o perfil de cada usuário na internet e estabelecer o que será oferecido para cada pessoa individualmente.

Ao comprar um livro em uma loja virtual ou assistir a um filme da Netflix você pode pensar que foi o responsável pela sua decisão. Mas o “cardápio de filmes e livros” expostos para você está longe de corresponder à totalidade de filmes e livros disponíveis nesses bancos de dados. Por trás das escolhas que fazemos existem algoritmos de recomendação que são baseados em escolhas anteriores e buscas feitas por você. O mesmo vale para um caminho proposto pelo Waze, a aprovação ou negação de créditos no seu banco, entre outras decisões que também são tomadas por uma inteligência artificial baseada em algoritmos

Dessa forma, a utilização da inteligência artificial de maneira irrestrita, e sem nosso consentimento, ela reduz a nossa liberdade de escolha e toma diversas decisões por nós. Embora isso aumente a eficiência de nossa experiência na internet (já que oferece a nós aquilo que supostamente queremos), também nos impede de conhecer coisas novas e sair da bolha dos nossos gostos (ou ao menos torna isso mais difícil).

2) Morte de civis e aproximação de uma nova revolução armamentista

“Eu não amo mais os céus azuis. Na verdade, eu agora prefiro o céu cinza. Os drones não voam quando o céu está cinza“. Essa declaração foi feita por um garoto paquistanês de 13 anos logo após sua avó ter sido vítima de um ataque de drone. A imagem abaixo é de sua irmã, Nabeela, de 9 anos.

Os drones militares, usados principalmente em zonas de guerra, estão se tornando cada vez mais autônomos (com cada vez menos necessidade de humanos operando). Há uma forte tendência de que essa tecnologia seja levada também para armas de infantaria, representando praticamente uma terceira grande revolução nas guerras, depois da pólvora e das armas nucleares.

Embora existam argumentos interessantes à favor do desenvolvimento dessas tecnologias – como menor custo bélico, maior precisão em ataques, redução de perdas humanas – ao mesmo tempo essas facilidades proporcionariam uma produção em escala mundial e sem muita dificuldade cairia nos mercados negros, nas mãos de grupos terroristas e de ditadores. Seria uma faca de dois gumes.

![Protestos contra os ataques de drones no Paquistão, que resultaram em diminuição dos ataques desde o período de pico - em torno de 2009 a 2012. [Fonte: EPA]](https://www.blogs.unicamp.br/ciencianerd/wp-content/uploads/sites/113/2017/06/2011101105520331734_20.jpg)

Além do fato de ser um tanto controverso os Estados Unidos serem os responsáveis por definirem quem é e quem não é um terrorista, algo largamente questionado por diversas ONGs, iniciativas humanitárias e, naturalmente, as populações vítimas desses ataques.

3) Fim de diversos empregos e possível desindustrialização

Um problema da inteligência artificial que atinge a nós do ocidente mais diretamente é a substituição de humanos por máquinas, criando potencial para o fim de vários empregos.

A BBC publicou um trabalho realizado na Universidade de Oxford que verificou quão suscetível à automação nos próximos 20 anos cada trabalho está, baseado nas habilidades necessárias para desempenhá-los, como percepção social, negociação, persuasão, assistência e cuidado com pessoas, originalidade, destreza manual, espaço necessário para trabalhar, etc.

Você pode conferir alguns dos empregos na tabela abaixo, ou pesquisar por outros no site da BBC.

| Ranking | Função / Emprego | Risco de ser automatizado |

| 1º | Vendedor de telefone | 99,0% |

| 3º | Secretário de direito | 97,6% |

| 22º | Recepcionista | 95,6% |

| 35º | Empregada doméstica | 94,4% |

| 159º | Motorista de taxi e afins | 56,8% |

| 281º | Profissional de ensino de ensino primário e infantil | 8,9% |

| 316º | Artista | 3,8% |

| 360º | Psicólogo | 0,7% |

A automatização nas fábricas está produzindo um efeito ainda mais drástico em âmbito nacional, podendo levar a um processo cada vez maior de desindustrialização. Quando uma empresa sai do seu país de origem para um mais pobre ela tem uma série de novos problemas para lidar (como taxas de importação/exportação, custos com transporte, adaptação à legislação local, etc.). O que faz valer a pena esse processo são fatores como redução do custo de mão de obra, menor carga tributária (ou mesmo incentivos fiscais).

No entanto, com a possibilidade de uma indústria operando com pouquíssimos funcionários (ou até nenhum), os benefícios oferecidos por esses países mais pobres já não importarão tanto. E, por essa razão, a China e vários outros países já têm perdido diversas empresas, que estão voltando para seus países de origem e com quase nenhum funcionário. Desse modo, os empregos, a arrecadação de impostos e os benefícios gerados pela industrialização, podem estar com os dias contados, acabando com uma importante forma que esses países em desenvolvimento tinham para crescer.

Watson IBM, Amazon Go e os carros autônomos

Um exemplo de profissão que precisará se adaptar ao desenvolvimento tecnológico são os médicos (ao menos algumas especialidades). O computador Watson, da IBM, utiliza inteligência artificial para gerar diagnósticos (principalmente de câncer) e tem obtido resultados até superiores aos diagnósticos feitos por humanos. A tecnologia tem sido usada não só no campo da medicina, mas em várias outras áreas, como em criação de campanhas para mídias sociais, promoção de maior engajamento para consumidores de uma marca, serviços variados de contabilidade, análise e predição de crimes, e até para utilidades pessoais e serviços domésticos.

Outra gigante que está na vanguarda da aplicação de inteligência artificial é a Amazon. O conceito da Amazon Go é uma tentativa de não só retirar os atendentes nas caixas registradoras (como já é comum em vários países) como eliminar a necessidade de realizar qualquer pagamento no ato da compra. Você simplesmente chega no supermercado, autentica a sua entrada com seu smartphone e, à medida que pega os itens da loja e coloca no seu carrinho, o sistema identifica os produtos que você está pegando e desconta direto no seu cartão de crédito.

Outra gigante que está na vanguarda da aplicação de inteligência artificial é a Amazon. O conceito da Amazon Go é uma tentativa de não só retirar os atendentes nas caixas registradoras (como já é comum em vários países) como eliminar a necessidade de realizar qualquer pagamento no ato da compra. Você simplesmente chega no supermercado, autentica a sua entrada com seu smartphone e, à medida que pega os itens da loja e coloca no seu carrinho, o sistema identifica os produtos que você está pegando e desconta direto no seu cartão de crédito.

Também já em fases de testes, como a Amazon Go, os carros autônomos estão cada vez mais próximos de uma comercialização massiva. A tecnologia tem sido usada tanto em veículos de pequeno porte quanto em caminhões. A Otto, empresa recém comprada pela Uber, fez a primeira entrega de cerca de 50 mil garrafas de cerveja, percorrendo 193 Km nos Estados Unidos. Os motoristas que realizam serviços mais especializados – como transporte de substâncias tóxicas, inflamáveis, etc. – talvez não sejam tão afetados. Mas os caminhoneiros em geral, que hoje representam o maior número de autônomos nos Estados Unidos, e motoristas pessoais podem ser substituídos em pouco tempo por veículos automatizados.

Também já em fases de testes, como a Amazon Go, os carros autônomos estão cada vez mais próximos de uma comercialização massiva. A tecnologia tem sido usada tanto em veículos de pequeno porte quanto em caminhões. A Otto, empresa recém comprada pela Uber, fez a primeira entrega de cerca de 50 mil garrafas de cerveja, percorrendo 193 Km nos Estados Unidos. Os motoristas que realizam serviços mais especializados – como transporte de substâncias tóxicas, inflamáveis, etc. – talvez não sejam tão afetados. Mas os caminhoneiros em geral, que hoje representam o maior número de autônomos nos Estados Unidos, e motoristas pessoais podem ser substituídos em pouco tempo por veículos automatizados.

Quão problemático isso é?

É evidente que todas essas tecnologias, em particular as citadas no item 3, trarão diversos benefícios e facilidades para a população. Elon Musk, o multifacetado empresário da Pay Pal, Tesla Motors e SpaceX (a primeira empresa a vender um voo comercial para a Lua), afirma que a única solução global para o trânsito é a automação dos carros. O próprio uso de aplicativos de geolocalização já parecem estar correlacionados à diminuição do trânsito de metrópoles como São Paulo, porque estão levando as pessoas a se utilizarem mais de vias alternativas menos conhecidas. Benefícios e facilidades de mesma ordem podem derivar de outros sub-produtos da inteligência artificial – como os próprios, já citados, Amazon Go e Watson.

No entanto, “não existe almoço grátis”, como lembra o ditado. Quão preparados estaremos para essa enorme revolução, talvez uma Quarta Revolução Industrial, como alguns dizem? É fácil enxergar as revoluções anteriores como benéficos para o progresso da humanidade – e de fato foram. Só que nós estamos pelo menos 60 anos na frente da última. Para quem viveu qualquer uma das revoluções industriais, essa fase passou longe de ser agradável e de parecer benéfica.

É claro que é muita especulação dizer que a inteligência artificial trará o fim de vários empregos e o caos se instaurará (tão especulativo quanto dizer que a singularidade bate à porta). Mas essa incerteza do que o futuro nos guarda, que sem dúvida pairou sobre os ares das três revoluções industriais que a humanidade viveu, voltará a nos tomar de assalto.

Será que estaremos preparados para passar, hoje, por um evento como esse? Que poderá transformar de maneiras inimagináveis as relações de trabalho e as relações sociais como conhecemos hoje? Será que nos adaptaremos com facilidade às demandas que surgirão? Será que os governos estarão prontos para realocar todos os que serão substituídos por máquinas? Etc, etc, etc.

O que podemos concluir disso tudo?

Por mais que a ficção científica e vários futuristas e cientistas da computação nos alertem para os perigos da singularidade (ou nos encantem com seus benefícios), essa não deve ser a nossa preocupação no momento.

Como vimos, existem outros problemas muito mais urgentes e que já estão nos afetando, direta ou indiretamente. Essas consequências são grandes e transformam consideravelmente nosso modo de vida atual, portanto é preciso estarmos sempre atualizados nesse assunto e participarmos de discussões sobre a inteligência artificial e seus produtos. Por mais que isso tudo pareça muito complexo, afinal, estamos falando de tecnologias de ponta sendo desenvolvidas pelos maiores especialistas no assunto, a discussão sobre a sua aplicabilidade e financiamento de novas pesquisas no campo cabe sim a nós leigos e à população em geral.

—-

Algumas referências que usei:

Matéria do El País Brasil – Cientistas contra robôs armados

Texto do Blog ComputerWorld – Onde os algoritmos e a inteligência artificial vão nos levar?

Texto da Hypescience – 12 motivos pelos quais os robôs vão dominar o mundo

Matéria da Super Interessante – As Três Leis da Robótica

Texto de Vernor Vinge publicado pela Nassa (inglês) – A chegada da Singularidade Tecnológica

Ótimo texto! Alguns comentários:

– Não há motivo pros robôs terem uma ética superior a humana, afinal geralmente quando pensamos em inteligência artificial estamos falando de aprendizagem por redes neurais, e para tanto é preciso “treinar” a IA para reconhecer padrões. Em atividades humanas estas serão treinadas por humanos e herdarão nossa moral, não? Um exemplo que vem a minha cabeça é o chatbot da Microsoft “Tay” que tentava aprender a “conversar como um humano” no Twitter e acabou virando um chatbot nazista (http://uk.businessinsider.com/microsoft-deletes-racist-genocidal-tweets-from-ai-chatbot-tay-2016-3)

– E sobre as leis da robótica, apesar do Asimov ter inventado elas no “Eu, Robô”, praticamente todas as histórias do livro acontecem porque uma ou mais regras falharam e geraram um problema imenso XDD

Obrigado Eduardo!

Faz sentido mesmo. Eles provavelmente herdariam o nosso senso de moral. Acho que isso também não impede que essa moral mude – como muda a nossa. Numa situação super hipotética, onde os robôs tenham, de fato, uma inteligência e sejam autônomos pra “pensar”, acredito que seja possível eles construírem uma moral própria. Mas acho muito difícil imaginar uma situação dessas. A gente nem sabe direito qual que é a relação entre cérebro e consciência (ou mente), se eles tem uma relação causal ou se são somente correlacionados, se são independentes ou não. Talvez seja um dos maiores limitantes que tenhamos hoje em IA, entender o cérebro.

E o chatbot nazista é muito assustador. E ele nada mais é do que um reflexo nosso né, já que aprendeu com os humanos.

E é verdade. Não há nenhuma garantia de que essas leis serão respeitadas e sempre há a possibilidade delas falharem.

Que bom que tem esse espaço para comentar.

num é? E que bom que tem esse espaço pra responder rsrs