Injustiça Fisiológica

E segurou sua mão até adormecer

E dormentes ficaram: Eles e as mãos

Até que não mais soubessem se laçavam-se ou não

as mãos ou se seriam elas parte de seu próprio ser

~ o ~ o ~

Ao terminar o pequeno verso, lembrou imediatamente de suas aulas de neurofisiologia. Lembrou da foto que o professor mostrou com os receptores cutâneos que permitiam o sentido do tato.

Receptores cutâneos e seus padrões de adaptação.

Figura. Receptores cutâneos. Painel central (amarelo). Gráfico mostrando um estímulo padrão (trapezoide) e o ritmo de disparo (representado pela sequência de retas logo abaixo) dos 4 tipos mais comuns de receptores cutâneos. Notar como os disparos (impulsos elétricos emitidos) decaem com o tempo de forma diferente de acordo com cada receptor. O receptor de Meissner (quadrante superior esquerdo) por exemplo, dispara apenas no início e no final do estímulo. Há receptores que exibem adaptação rápida (Fast Adaptation – FAI e FAII na coluna à esquerda) e os que exibem adaptação lenta (Slow Adaptation – SAI e SAII, coluna à direita). As mãos mostram as respectivas distribuições dos receptores. Modificado do Neurobiography (http://www.neurobiography.info/teaching.php?lectureid=65&mode=handout)

Lembrou também que os receptores do tato apresentam o fenômeno de adaptação e que as pequenas fibras dos neurônios tipo IV do grupo C, chamadas de nociceptivas por conduzirem os impulsos dolorosos, não. A adaptação, grosso modo, é uma diminuição da frequência e/ou intensidade dos disparos elétricos de receptores nervosos em decorrência da constância de um estímulo no tempo. Nocicepção (mesma raiz de “nocivo”) se refere a impulsos que podem levar à perda da integridade do tecido ou mesmo do organismo, ou seja, machucam. Esses estímulos não adaptam da mesma forma como os do tato por razões de proteção ao indivíduo. Assim, a dor pode persistir por longos períodos diferentemente dos estímulos mais suaves, em especial, se as condições do ambiente permanecerem constantes. Como no caso de mãos dadas e imóveis por longos períodos. Nenhuma ameaça ao indivíduo nesse caso.

Ele não pôde evitar que passasse pela sua cabeça uma certa sensação de “injustiça fisiológica”. Como podemos nos adaptar (parar de sentir) um carinho e, no entanto, deixamos que a dor continue a doer? A biologia tem lá suas razões. O curioso é a humanidade ter emergido a partir de reflexos assim. Curioso também a poesia condensar tanta neurofisiologia num verso.

Pensando bem, humanos talvez sejam exatamente isso.

Um monte de poesia condensada contidos por uma fisiologia lapidada pelo tempo e temperada com aquela pitada de injustiça; que teima em não se adaptar.

PS. Esse post é uma republicação. O original saiu no blog Ciensinando do Gabriel Cunha que infelizmente já não está mais no ar.

O Significado de uma Morte

Para os palestinos, cujo laudo foi divulgado pelo próprio Hussein Al Sheikh (um tipo de chefe da Casa Civil palestina), a morte foi causada por asfixia, provável broncoaspiração de conteúdo gástrico causada por vômitos devida a aspiração do gás lacrimogêneo, com o agravante de traumatismo torácico (Abu Ein teria sido agredido no tórax). Para Chen Kugel, chefe do Instituto Forense de Abu Kabir em Tel Aviv, e Mia Forman, patologistas israelenses, a morte foi causada por “bloqueio do fluxo sanguíneo no tronco da artéria coronária causado por uma hemorragia no interior de uma placa aterosclerótica, causada por estresse”. Ou seja, um infarto agudo do miocárdio. Declarações oficiais não descartaram o papel de um “semi-estrangulamento” no processo, mas subentende-se que a possível realização de procedimentos de ressuscitação, como a massagem cardíaca, poderiam ser responsáveis pela hemorragia cervical e torácica encontradas durante a autópsia. Afirmam que o coração de Abu Ein estava em condições muito ruins e que ele apresentava várias obstruções coronarianas bem como cicatrizes no músculo cardíaco sugestivas de ataques isquêmicos prévios.

Suponhamos, apenas para levar a cabo este argumento, que os médicos, israelenses e jordanianos, tenham sido treinados de acordo com os preceitos médico-científicos de busca pela verdade factual e que não sofressem nenhum tipo de pressão política por parte de seus “superiores”, qual seria a chance de chegarem a um acordo sobre o laudo necroscópico? Seria possível que pessoas com visões de mundo tão diferentes e antagônicas pudessem colocar a ciência acima de suas convicções e admitir uma hipótese contrária a que inicialmente consideravam ser a correta? Não estaria o significado da morte de Ziad Abu Ein já dado – por ambos os lados – não importando os diversos achados fornecidos pela autópsia? Tal raciocínio nos leva a questionar qual a capacidade da ciência médica em atribuir significados aos padecimentos humanos. A autópsia e sua racionalidade fisiopatológica baseada nas relações de causa-efeito que tanto progresso trouxeram à medicina seriam capazes de “significar” o desaparecimento precoce de um homem público? De qualquer homem ou mulher? O advento da AIDS e a recente epidemia do Ebola têm algo a nos dizer sobre isso. A pergunta é tão relevante que merece uma generalização transcendental…

Seria a ciência, médica ou não, capaz de atribuir significados a totalidades humanas em suas derradeiras e trágicas possibilidades que não são outras senão aquelas que as defrontam com sua própria extinção? Se, como arguiriam alguns, a atribuição de significados não é papel da ciência, por que insistimos em solicitá-los à ela? Ou ainda, numa tentativa desesperada, eu perguntaria que tipo de “ciência” então poderia nos socorrer de forma a explicar o fosso movediço do universo dos significados atribuídos e, principalmente, nos livrar da arbitrariedade e do dogma?

Não vejo a solicitação da autópsia como um erro; pelo contrário. O que pode não ser justo talvez seja a desigualdade de forças entre o discurso científico e a construção de um significado que, no caso da morte de uma pessoa pública, assume sempre proporções perigosamente desmesuradas. Para Israel, a morte do ativista foi uma “fatalidade”. Para os palestinos, seu “assassinato” o transforma em mártir. Compreender o significado que o outro atribui é visualizar um mesmo horizonte. “Compreender é compreender-se” e isso é o que falta ali. A ciência e a medicina não têm a ver com isso. Sua importância é bem maior do que torná-las meros instrumentos de manipulação de significados.

Raízes do Plátano – Tecnologia

Esta série de posts inicia-se aqui.

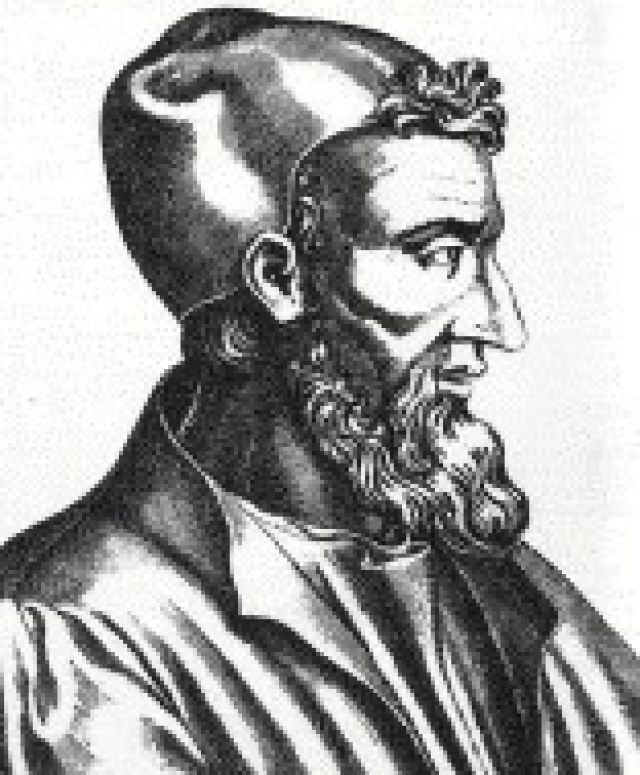

Cláudio Galeno (129- 199 ou 217) foi o médico mais famoso do período romano. Há relatos de que era um grande cirurgião[1] e acrescentou aos conhecimentos médicos de sua época, fortemente embasados nos escritos hipocráticos, uma relevante contribuição pessoal, em especial, relacionada à teoria humoral. Dizia não pertencer a nenhuma das escolas médicas de seu tempo que se diferenciavam mais por suas bases filosóficas (empiristas, dogmáticos, metódicos, entre outros) que por seus resultados, em geral, muito ruins. O método de Galeno era mais próximo de um “empirismo crítico aristotélico fundamentado em cuidadosas observações e com uma coerente base teórica que lhes dava suporte“. Com isso, Galeno logrou fama em todo o mundo antigo o que, associado a sua habilidade e disposição como escritor, transformou-o na referência médica da antiguidade por nada menos que quatorze séculos (do século II ao XVII d.C.!) A influência de Galeno foi de tal magnitude e se deu por tanto tempo que historiadores apelidaram a forma de fazer e ensinar medicina a partir de suas diretrizes de Galenismo. O galenismo se constitui, portanto, no arcabouço teórico-prático da medicina na Antiguidade. Era caracterizado, em especial em seu momento mais tardio, por um marcado autoritarismo e culto aos antigos. As aulas nas faculdades de medicina do período medieval constituíam-se basicamente em leituras dos originais, em latim ou grego, dos clássicos do Corpus Hippocraticum e das obras galênicas. Autópsias não eram realizadas no mundo ocidental, seja por receio de represálias da Igreja, seja por mera falta de interesse; esta última hipótese a mais provável já que, numa medicina humoral, o estudo do cadáver inanimado pouco poderia acrescentar à compreensão da crásis (mistura de humores) dos vivos. (Galeno, talvez, não tenha dissecado cadáveres humanos ele mesmo. Conta-se que observou dissecções de outros mestres em suas viagens ao Oriente próximo).

No final do século XVI e início do XVII, as teorias de Galeno começam a ser questionadas em várias frentes. Para citar apenas alguns “focos” de corrosão do grande sistema galênico temos: Paracelsus (1493 – 1541), iatroquímico, que, dizia-se, queimava livros de Galeno em demonstrações públicas, defendendo que o uso de substâncias químicas poderia suprir deficiências orgânicas. Introduziu o zinco e o laudanum (opiáceo) na medicina; Andreas Vesalius (1514 – 1564) que publicou uma obra monumental de anatomia humana totalmente baseada em dissecções, vejam só, humanas, chamada De Humanis Corporis Fabrica (isso tudo aos 28 anos de idade), com conceitos anatômicos válidos até hoje e mostrando várias contradições nos ensinamentos de Galeno; Girolamo Fracastoro (1476 – 1553) fez várias contribuições[2], mas em seu livro de 1546 – De contagione – lança as bases para a teoria infecciosa das doenças: como explicar tantas “discrasias” humorais em determinadas localidades num espaço tão curto de tempo?; William Harvey (1578 -1657), do qual ainda falaremos um pouco mais, que deduziu a circulação do sangue a partir de seus cálculos e publicou seu famoso De Motu Cordis et Sanguinis in Animalibus em 1628, mostrando ser impossível a fisiologia galênica na qual o sangue venoso era produzido no fígado e o arterial, no coração, com o pulmão representando o papel secundário (e isso é totalmente inadmissível!) de resfriador do processo todo; e, finalmente, para ficar apenas em alguns, Marcello Malpighi (1628-1694) que posteriormente descobriu, entre várias outras estruturas, os capilares em animais e, assim, a ligação entre as artérias e as veias, comprovando os trabalhos de Harvey.

Com isso, as teorias e, principalmente, o modo de fazer e ensinar medicina baseado no galenismo foram se tornando obsoletos e progressivamente cederam lugar a novas formas de pensar o ser humano enfermo e também de ensinar a arte médica. Mas, consideremos agora a parada intencional de nossa viagem em Malpighi para, a partir dele, seguirmos por um caminho que, apesar de muito simples e estreito em seu início, vai tomar corpo e transformar-se em uma grande e moderna via do pensamento médico contemporâneo. Malpighi era físico, biólogo, médico, óptico, inventor e um desenhista talentoso. Discutiu longamente com filósofos peripatéticos e galenistas que dominavam a academia à época. Cansado das polêmicas infrutíferas, saiu e voltou de várias universidades por essa razão. Queria a prática. E seu microscópio. Ensinou medicina ao seu modo, porém, na Universidade de Bolonha e lá formou um indivíduo chamado Antonio Valsalva (1666 – 1723). Valsalva, conhecido pela manobra que leva seu nome, tornou-se um grande anatomista e estudioso das estruturas do ouvido, mas não escreveu muitas obras tendo sido um aluno seu quem as compilou e publicou postumamente. Esse aluno era Giambattista Morgagni (1682 – 1771).

Giambattista Morgagni (1682 – 1771)

Em 1761 (ou 1760), Morgagni publica o De sedibus et causis morborum (Da sede e causas das doenças), obra monumental em cinco volumes, decorrente de suas observações em autópsias e identificou os órgãos internos como os focos patológicos das doenças. A importância desse estudo é que ele representa a primeira tentativa de localização anatômica das doenças. Apesar de grande anatomista, Morgagni não tinha a clínica como gabarito para seus achados. Assim, escreve Foucault, “o princípio diretor da análise nosológica era a dispersão anatômica: o frenesi fazia parte, como a apoplexia, das doenças da cabeça; asma, peripneumonia e hemoptise formavam espécies próximas, por estarem localizadas no peito. O parentesco mórbido se baseava em um princípio de vizinhança orgânica: o espaço que o definia era local. A medicina das classificações e, em seguida, a clínica haviam retirado a análise patológica deste regionalismo e constituído para ela um espaço ao mesmo tempo mais complexo e mais abstrato, que dizia respeito a ordem, sucessões, coincidências e isomorfismos”[3]. A medicina, lenta e silenciosamente, vai então deixando para trás a história para concentrar-se numa geografia das doenças, para usar a bonita analogia do próprio Foucault.

Em Foucault encontramos ainda a apreensão desta mudança do pensamento médico cristalizada em seu inconfundível e dramático estilo: “Anatomia e clínica não têm o mesmo espírito: por mais estranho que possa parecer, agora que a coerência anátomo-clínica está estabelecida e enraizada no tempo, foi um pensamento clínico que durante 40 anos impediu a medicina de ouvir a lição de Morgagni. O conflito não é entre um saber jovem e velhas crenças, mas entre duas figuras do saber. Para que, do interior da clínica, se esboce e se imponha o apelo da anatomia patológica, será preciso uma mútua reorganização: nesta, o aparecimento de novas linhas geográficas, naquela, um novo modo de ler o tempo. No final desta litigiosa estruturação, o conhecimento da viva e duvidosa doença poderá se ajustar à branca visibilidade dos mortos” (Foucault, p. 144).

O aparecimento das tais “novas linhas geográficas” que permitirão a reorganização dos saberes médicos vai ocorrer em Paris. No século XIX. E se desdobrará até os dias de hoje, como tentarei mostrar adiante, nos ajudando a entender a maneira ambivalente como a medicina contemporânea lida com a tecnologia.

Notas e Referências

[1] Conta uma lenda que em longa viagem de estudos para a Ásia Menor, onde julgava existir as melhores escolas de medicina, Galeno indispôs-se com os médicos de uma localidade. Para desafiá-los, eviscerou um macaco, animal que estudou profundamente, e solicitou a eles que o salvassem. Totalmente sem ação e horrorizados com o ato, os médicos da corte observaram, então, Galeno suturar o abdome do animal com destreza e mantê-lo vivo muitos dias depois. Com isso, o rei local o nomeou seu médico particular, cargo que ocupou por tempo suficiente apenas juntar dinheiro e engajar-se em nova jornada. As habilidades cirúrgicas de Galeno passaram para história da medicina sendo atribuída a ele técnicas hemostáticas como ligar (amarrar) pequenas artérias sangrantes.

[2] Fracastoro é o autor do famoso poema de 1530, publicado em três volumes: Syphilis sive morbus gallicus e que deu nome à doença.

[3] FOUCAULT, M. O nascimento da clínica. Rio de Janeiro: Editora Forense Universitária, 1a Edição, 1977. Todo o capítulo VIII.

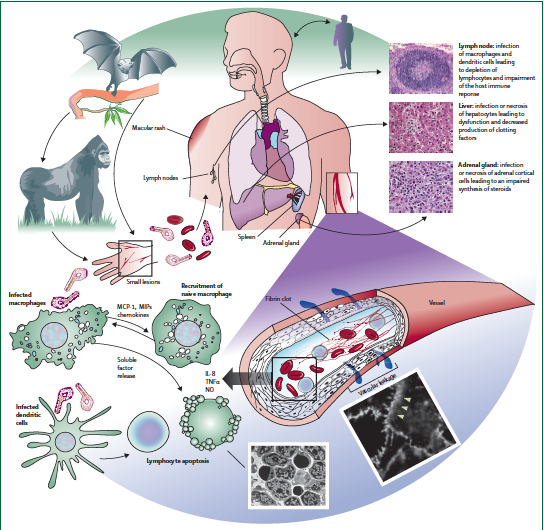

A Febre Hemorrágica do Ebola

Em 1976, no antigo Zaire, hoje República Democrática do Congo (RDC), uma estranha e desconhecida doença caracterizada por febre alta, hemorragias na pele e nos órgãos internos, começou a acometer os moradores de uma pequena cidade ribeirinha chamada Yambuku. A mortalidade chegou a quase 90% e chamou a atenção das autoridades. Após auxílio internacional, um grupo de pesquisadores descobriu que o agente causador era um vírus filamentoso da mesma família do Marburg descrito na Alemanha, quase uma década antes. O vírus foi batizado como Ebolavirus (pronuncia-se ébola) dado que a doença já era conhecida como Febre Hemorrágica do Ebola, segundo o rio que banhava a cidade, tributário do Mongala que, por sua vez, desemboca no grande rio do Congo.

No mesmo ano, nas cidades de Maridi e Nzara, Sudão do Sul, a mais de 1000 km em linha reta ao norte de Yambuku, uma epidemia com características muito semelhantes também eclodiu. Pesquisadores encontraram uma variante do mesmo vírus do Ebola nos pacientes acometidos. Outras epidemias surgiram no final da década de 70, não só na África, o que, ao fim e ao cabo, permitiu a identificação de 5 sorotipos da família Ebola: 1. Bundibugyo ebolavirus (BDBV); 2. Zaire ebolavirus (EBOV); 3. Reston ebolavirus (RESTV); 4. Sudan ebolavirus (SUDV); 5. Taï Forest ebolavirus (TAFV). O RESTV foi encontrado em macacos importados de Mindanao, nas Filipinas, para Reston, Virginia, nos Estados Unidos e não é considerado causador de doença humana.

O comportamento epidemiológico estranho do Ebola não parou por aí. Após ter aparecido na África em 1976 – 1979, ele simplesmente sumiu das estatísticas até 1994. Acredita-se que permaneceu oculto, circulando em seus reservatórios naturais. Um reservatório natural de um patógeno é um hospedeiro, animal ou inseto, que por não apresentar as características da doença, “convive” com o agente de forma pacífica. No Brasil, tatus são reservatórios para doença de Chagas e morcegos podem abrigar o vírus da raiva. O problema é que, no caso do Ebolavirus, esse reservatório, até hoje pelo menos, não foi confirmado, suspeitando-se de roedores e morcegos já que seu primo, o Marburg, tem como reservatório um morcego de caverna (o Rousettus aegyptiacus).

A Febre Hemorrágica do Ebola é o protótipo de uma zoonose. Uma zoonose é uma doença transmitida por animais (e.g. Raiva), e também não foram encontrados vetores para a doença. Um vetor é um bicho (pode ser animal ou inseto) que transmite determinada doença (e.g. o mosquito da Dengue, Aedes aegypti). O comportamento esquivo das epidemias poderia ser explicado por situações que alterariam o ecossistema dos reservatórios proporcionando altos índices de infecção nos humanos de tempos em tempos.

Quadro Clínico

O período de incubação da doença é de 4 a 10 dias (variando de 2 a 21). É, logo de início, uma doença sistêmica (como são por exemplo, os casos de infecção generalizada por bactérias – sepse -, as vasculites de causas imunológicas, a pancreatite aguda necro-hemorrágica, grandes queimados e politraumatismos extensos), o que dificulta seu tratamento e aumenta sua gravidade. O paciente sente-se extremamente indisposto, com dor abdominal, náuseas e vômitos (que podem conter sangue), diarreia (com ou sem sangue), falta de ar, tosse, pressão baixa, dor de cabeça, confusão mental e coma. Podem ocorrer hemorragias cutâneas e viscerais e a pele costuma descamar para cicatrizar ad integrum nos sobreviventes. Um quadro chamado de coagulopatia intravascular pode ocorrer e é, em geral, fatal. Virtualmente, todos os vasos sanguíneos do organismo podem sangrar e o quadro é realmente dramático. Tal problema não é, infelizmente, incomum em casos graves causados por outras doenças e não é uma exclusividade do Ebola. A Dengue, por exemplo, é a febre hemorrágica mais comum do planeta.

Mortalidade

A virulência do Ebola parece depender do sorotipo causador. A mais letal parece ser a EBOV seguida pela SUDV, com 60–90% e 40-60% de case-fatality (porcentagem de pessoas que contraíram a doença e que vieram a falecer dela, direta ou indiretamente), respectivamente, o que é muito. Devemos lembrar, entretanto, que tais epidemias ocorreram em locais onde os cuidados médicos estavam longe de ser ideais o que pode falsear as estatísticas. De qualquer forma, é uma doença muito grave.

Modo de Infecção

O Ebolavirus parece penetrar no organismo humano através de superfícies mucosas, lesões cutâneas, ferimentos ou pelo sangue. Muitas das infecções causadas em humanos, em especial o grande contingente de agentes da saúde, parecem ter ocorrido pelo contato direto com pacientes infectados. Partículas de RNA vital foram encontradas no esperma e secreções vaginais de pacientes, bem como em outros fluidos como secreções nasais. Ferimentos acidentais por agulhas e material contaminado são importantes rotas de infecção. As epidemias africanas da década de 70 foram atribuídas ao consumo de morcegos e macacos. Não é confirmada, até o momento, a transmissão por aerossóis.

Precauções e Tratamento

O isolamento dos pacientes é uma eficiente medida de proteção já que o tratamento específico ainda é objeto de pesquisas. Medidas de suporte precoces como hidratação e cuidados intensivos são muito importantes e fazem grande diferença na mortalidade. Entretanto, há que se chamar a atenção para o caso dos dois agentes sanitários americanos recentemente submetidos a uma terapia experimental para o tratamento da doença contraída em campo. Kent Brantly e Nancy Writebol contraíram a Febre Hemorrágica do Ebola na Libéria trabalhando em uma organização cristã de auxílio às vítimas da doença. Apesar do protesto absurdo de alguns sobre a repatriação de americanos infectados, o fato é que, baseados em um relato de caso no qual o soro de pacientes sobreviventes conseguira reverter a doença, um consórcio de pesquisadores conseguiu desenvolver uma solução com anticorpos monoclonais contra determinados antígenos imunogênicos do vírus e curar os dois missionários, fato amplamente divulgado na mídia.

Futuro

Não é impossível que a Febre Hemorrágica do Ebola desembarque no Brasil. Contam a nosso favor, seu modo peculiar de transmissão, seus possíveis reservatórios (ausentes aqui?), nossa experiência em tratar a dengue hemorrágica e nosso sistema de saúde, que se não é a segunda maravilha do mundo, é bastante superior e estruturado comparado ao da maioria dos países africanos. Contra nós, pesa nossa eterna ineficiência sanitária e as grandes conglomerações nas cidades.

De vez em quando, uma epidemia qualquer com “potencial” de extermínio da humanidade “aporta” neste blog. Gosto de citar como exemplo minha pior experiência com tais epidemias que foi com a Síndrome de Weil, a forma hemorrágica da leptospirose humana, na epidemia ocorrida em São Paulo no final dos anos 90. Naquela época, de enchentes, diga-se de passagem, a doença transmitida pela convivência promíscua com roedores, atingiu em cheio a parte mais pobre da população. Ver homens, mulheres e crianças em macas sangrando por quase todos os orifícios foi das minhas piores vivências que tive como médico. Passou. Estamos aqui. No caso do Ebola, já temos até o caminho a seguir para conseguir a cura. Resta saber se as instituições envolvidas na descoberta do “soro mágico” contra a doença possibilitem sua oferta para quem mais necessita. Isso sim, a possibilidade de me decepcionar uma vez mais com a espécie humana, me dá um medo desgraçado.

Bibliografia

![]() Feldmann, H., & Geisbert, T. (2011). Ebola haemorrhagic fever The Lancet, 377 (9768), 849-862 DOI: 10.1016/S0140-6736(10)60667-8

Feldmann, H., & Geisbert, T. (2011). Ebola haemorrhagic fever The Lancet, 377 (9768), 849-862 DOI: 10.1016/S0140-6736(10)60667-8

![]() Peters, C., & LeDuc, J. (1999). An Introduction to Ebola: The Virus and the Disease The Journal of Infectious Diseases, 179 (s1) DOI: 10.1086/514322

Peters, C., & LeDuc, J. (1999). An Introduction to Ebola: The Virus and the Disease The Journal of Infectious Diseases, 179 (s1) DOI: 10.1086/514322

![]() Mupapa, K., Massamba, M., Kibadi, K., Kuvula, K., Bwaka, A., Kipasa, M., Colebunders, R., Muyembe‐Tamfum, J., & , . (1999). Treatment of Ebola Hemorrhagic Fever with Blood Transfusions from Convalescent Patients The Journal of Infectious Diseases, 179 (s1) DOI: 10.1086/514298

Mupapa, K., Massamba, M., Kibadi, K., Kuvula, K., Bwaka, A., Kipasa, M., Colebunders, R., Muyembe‐Tamfum, J., & , . (1999). Treatment of Ebola Hemorrhagic Fever with Blood Transfusions from Convalescent Patients The Journal of Infectious Diseases, 179 (s1) DOI: 10.1086/514298

Paris, Século XIX

Honoré de Balzac – naquele que viria a ser o terceiro livro da primeira parte dos Estudos do Costume e o décimo-primeiro volume de sua monumental Comédia Humana, o romance de nome “A Casa Nucingen” – inicia sua narrativa com uma conversa de quatro jornalistas em um restaurante parisiense. Em determinado momento da discussão, que, a propósito, girava em torno da felicidade humana, Balzac coloca na boca de Émile Blondet a seguinte frase (em livre tradução): “A medicina moderna, cuja maior glória é ter, de 1799 a 1837, passado do estado conjectural ao estado de ciência positiva, muito pela grande influência da escola analista de Paris, demonstrou, sem dúvida, que o homem periodicamente renova-se por completo”[1]. O livro foi escrito em 1837 e publicado, inicialmente, na forma de folhetim nos jornais da época.

Deixemos – com Georges Canguilhem [2] – a questão da tal “renovação humana” de lado até porque, no livro de Balzac, tal observação não deixa muito claro seus objetivos. Canguilhem, ele mesmo médico e filósofo, tomou dois aspectos dessa frase de Balzac para analisar o que ele chama de “estatuto epistemológico da medicina”[2]: as datas e o sintagma “estado de ciência positiva”. Balzac era um grande cronista de sua época e não escolheria tais datas gratuitamente. Canguilhem identifica então alguns acontecimentos marcantes: em 1799, aconteceu o Golpe de Estado do 18 Brumário e a publicação da “Nosographie philosophique ou la methode de l’analyse applique à la médicine” de Pinel. [lembrar que a obra máxima de Xavier Bichat foi publicada em 1799/1800: Traité des membranes général et de diverses membranes en particulier]. Se, por um lado, 1837 não tem nenhum fato político relevante, do ponto de vista médico “é o ano da publicação do terceiro volume das ‘Leçons sur les phenomenes physiques de Ia vie’ de Magendie e também da quarta edição do ‘Traité d’ auscultation médiate’ de Laennec, revisado por Andral”. Entre as duas datas, ainda segundo Canguilhem, Xavier Bichat inventou a anatomia patológica, Pierre Louis instituiu as estimativas numéricas concernentes à tuberculose (1825), febre tifóide (1829) e aos efeitos do tratamento das pneumonias com sangria (1835), tudo isso sem esquecer que foi em 1830 que o primeiro dos seis volumes do “Curso de Filosofia Positiva” de Auguste Comte foi publicado. Eu ainda apontaria, na frase de Balzac, um terceiro elemento que mereceria atenção especial, apesar de Canguilhem não o destacar em seu texto: “escola analista de Paris”. Por que Paris? As transformações radicais que a prática médica sofreria nos anos seguintes à Revolução Francesa não foram ocasionadas por uma repentina descoberta científica ou por um avanço tecnológico súbito, nem tampouco tiradas da cartola de ninguém.

A mudança radical ocorrida na medicina foi uma revolução conceitual. A Revolução Francesa (1789-1799) fechou todos os serviços públicos de saúde para reabrí-los posteriormente. O Hotel Dieu (acima) tinha dependências insalubres e abrigava até 5 pacientes para CADA LEITO! [3]. Pessoas convalescentes, misturavam-se com as doentes, pessoas vivas misturavam-se aos cadáveres. Os quartos superlotados não tinham ventilação adequada. O pós-operatório (ainda não existia a anestesia) era ao lado da ala psiquiátrica onde “gritos eram ouvidos à noite toda”, são descrições comuns da época. Após a reabertura dos hospitais não foi permitido mais que um paciente por leito, mas a situação não melhorou muito. As clínicas médicas particulares foram praticamente extintas e os médicos passaram a exercer suas funções nesses hospitais. Alguns recebiam salários dos próprios hospitais (muito baixos, diga-se de passagem), mas o movimento aumentou muito. Os médicos tinham a oportunidade de ver centenas de pacientes nos ao invés de alguns poucos em suas clínicas privadas. Com isso, houve uma mudança na relação médico-paciente, com o primeiro ganhando poderes quase ilimitados sobre o segundo. Além disso, o órgão responsável pela saúde criado no período revolucionário e atuante também depois dele – Conseil Générale d’Administration – centraliza e expande a Saúde Pública determinando o acesso de todos. Por meio desse órgão, foi promulgada a “Lei das Autópsias” (art. 25 do decreto de Marly) que cobrava uma quantia para enterrar pessoas falecidas nos hospitais que a grande maioria da população não tinha condições de pagar. Os corpos então iam para sala de autópsias, permitindo “material” praticamente inesgotável de estudo para os médicos ávidos de conhecimento. Tal situação levou muitos médicos de outros países a estagiarem em Paris com objetivo de aprender as técnicas de autópsia e também a nova Anatomia Patológica [3].

A reviravolta epistêmica ocorrida nos mal-falados e escuros hospitais de Paris no século XIX repercute até hoje em todo o edíficio fulgurante da prática médica contemporânea. No novelo complexo dessa reviravolta é possível destacar quatro fios-de-meada, quatro “vertentes fundacionais” de conceitos formadores (e também deformadores, como veremos) do pensamento médico atual. Vertentes que, de certa forma, já estavam presentes em dispersos antecessores dos franceses e que, transformadas por estes, vieram tornar-se caudalosos rios nos quais os médicos navegam hoje. Se conhecer a nascente de um rio talvez não seja importante para navegá-lo, é ao menos prudente estudar a geografia de seu leito para que saibamos onde (e como vamos chegar a sua foz). Tentarei mostrar nos próximos posts de onde vêm e para onde vão quatro das principais ideias surgidas na Paris de Balzac e Canguilhem.

[1] de Balzac H, de Carvalho A. A casa Nucingen. Companhia Nacional Editora; 1891. Fac-símile em francês no site da Biblioteca Nacional da França. A referida passagem se encontra na página 13 da obra.

[2] ![]() Canguilhem, Georges (1988). Le statut epistémologique de Ia médecine. Hist. Phil. Life Sci., 10 (Suppl), 15-29.

Canguilhem, Georges (1988). Le statut epistémologique de Ia médecine. Hist. Phil. Life Sci., 10 (Suppl), 15-29.

[3] ![]() Waddington, I. (1973). The Role of the Hospital in the Development of Modern Medicine: A Sociological Analysis Sociology, 7 (2), 211-224 DOI: 10.1177/003803857300700204

Waddington, I. (1973). The Role of the Hospital in the Development of Modern Medicine: A Sociological Analysis Sociology, 7 (2), 211-224 DOI: 10.1177/003803857300700204

Figuras retiradas do bonito blog Dittrick Museum.

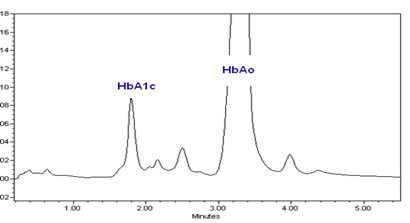

Glicose Média Estimada

O Sr. Apolônio olhou seus exames pela página do laboratório na internet e, estarrecido, viu sua glicose no valor de 123. Pensou, “estou diabético!!” Desesperou-se e correu para consulta com seu médico. Na consulta, verificou com auxílio do doutor, que havia duas dosagens de glicose em seus exames: a primeira, chamada glicemia de jejum que era de 87. A segunda, chamada de glicose média estimada (GME), tinha o valor de 123. Em qual acreditar? “Sêo” Apolônio está ou não diabético?

Esta tem sido uma dúvida comum no consultório desde que um exame chamado de glicose média estimada (GME) passou a integrar recentemente o rol de exames bioquímicos de alguns laboratórios. Ele é derivado da dosagem da hemoglobina glicada (HbA1c) e envolve, para sua correta interpretação, uma combinação de conceitos bioquímicos, fisiológicos e estatísticos aliados ao julgamento clínico e estimativas bayesianas sumárias. Tais conjecturas dão bem a ideia da complexidade envolvida na interpretação e aplicação clínica de um dado laboratorial de forma responsável. Outros textos relacionados a esse tema são O Check-up, “Procuradores” e “Achadores” e Os Efeitos Colaterais do Rastreamento. Neles, procuro abordar o tema do check-up e a interpretação dos exames que, claro, não se resume a avaliar se os resultados estão ou não dentro dos valores de referência.

Mas, voltemos ao Seu Apolônio e seu possível diabetes.

O principal achado do diabetes, qualquer que seja seu tipo, é a elevação crônica e persistente da concentração de glicose no plasma e outros fluidos corporais (como o liquor, interstício, urina, etc). Esse aumento estimula a ligação não-enzimática da glicose com proteínas orgânicas, sendo as mais estudadas a albumina, o colágeno, a LDL (fração que carrega a molécula de colesterol) e a hemoglobina. A hemoglobina tem a função de levar o oxigênio dos pulmões para os tecidos periféricos e, para isso, tem uma “relação de amor e ódio” com o gás. Se por um lado, precisa estar “muito afim” do oxigênio durante sua passagem pela circulação pulmonar, por outro, na periferia, tem que abrir mão dele de modo a liberá-lo para que seja utilizado pelos tecidos. Essa “mudança de comportamento” da hemoglobina é mediada por interações complexas entre os prótons, o ânion cloreto, uma molécula muito particular chamada de 2,3-difosfoglicerato, o gás carbônico e a temperatura e que ocorrem tanto no interior como na membrana da célula vermelha, a hemácia.

Por meio de uma ligação a moléculas de valina, a glicose altera o equilíbrio de cargas e deixa a hemoglobina com uma conformação quaternária (figura 1) de menor afinidade pelo O2.

Fig 1. Níveis de Estruturas Proteicas Genéricas.

A hemoglobina, como sabemos, está empacotada dentro das hemácias, uma das poucas células do organismo que não necessita de insulina para que a glicose adentre o meio intracelular. Essa adaptação é importante para que se possa garantir a entrega do O2: o metabolismo das hemácias só utiliza a via glicolítica, não convém ao entregador de pizza experimentar um pedaço da encomenda. Uma vez glicada, a molécula de hemoglobina só se livrará de seus açúcares quando for destruída e isso ocorre quando a hemácia fica velha, perdendo a flexibilidade de sua membrana. Nesse momento, no baço ou no fígado, ela ficará aprisionada em pequenos canais chamados sinusóides e será lisada (explodirá) liberando seu conteúdo para que seja reciclado. É possível por meio de técnicas de laboratório dosar essa hemoglobina glicada e o que veremos é um gráfico semelhante ao da figura 2 abaixo.

Fig 2. Cromatografia mostrando o pico de HbA1c (glicada) comparado com a HbAo (normal).

Ora, qual é a vida média de uma hemácia? Em torno de 120 dias. Então, alguém, há muitos anos atrás, pensou: se dosarmos a quantidade de hemoglobina glicada (HbA1c) presente no sangue de uma pessoa poderemos ter ideia da concentração de glicose que “bombardeou” suas hemácias nos últimos… 120 dias! Genial, não? Todos temos entre 3 e 4% de nossa hemoglobina ligada à glicose normalmente, sendo desprezível a participação de outros açúcares. A glicemia após um jejum de 12 horas pode vir baixa, mas a HbA1c não nos deixará enganar. Se a pessoa descuidou do diabetes nos últimos meses, o médico saberá. (Risada maligna).

Mas e a tal da glicose média estimada? Partindo-se do princípio de que existe uma relação direta entre a concentração de glicose plasmática e a taxa de glicação da hemoglobina, a HbA1c é um reflexo das variações da glicemia nos últimos meses e pode ser traduzida como se fosse um valor de glicose médio durante todo o período; como se a glicose fosse constante durante toda a vida das hemácias. Esta é a glicose média estimada. Sua relação com a HbA1c pode ser expressa pela função

GME (mg/dl) = 28,7 × HbA1c − 46,7

Que dá origem a tabela da figura 3.

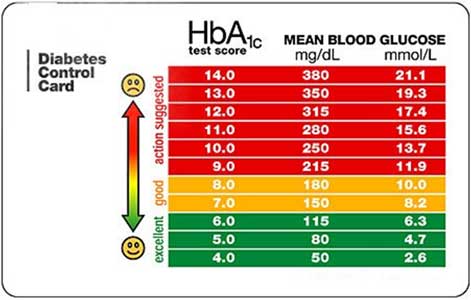

Fig 3. Tabela fornecida pela Associação Americana de Diabetes com a correlação entre HbA1c e a glicose média estimada (em duas unidades mg/dL e mmol/L, sendo a primeira mais utilizada no Brasil).

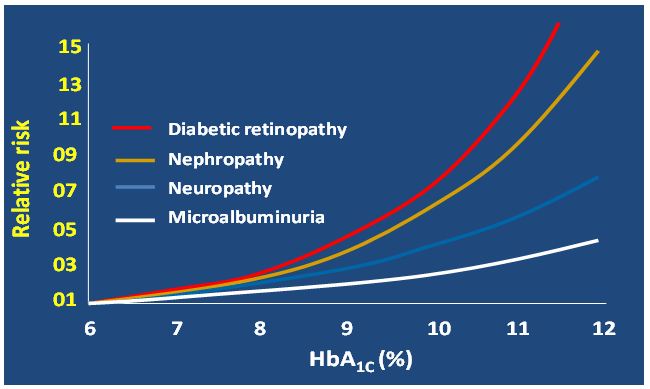

Isto posto, os valores de HbA1c e da GME são úteis para avaliarmos o controle do diabetes. Estudos têm mostrado que os níveis de HbA1c e sua correlata GME são preditivos de complicações do diabetes a longo prazo, como mostra a figura 4 abaixo.

Fig 4. Risco Relativo de complicações a longo prazo de acordo com o nível de HbA1c (clique na figura para o original).

Fig 4. Risco Relativo de complicações a longo prazo de acordo com o nível de HbA1c (clique na figura para o original).

Além disso, a HbA1c vem também sendo utilizada para o diagnóstico de diabetes. Pessoas com níveis acima de 6,5% são considerados diabéticos pela Organização Mundial da Saúde com a ressalva de que um nova dosagem deva ser realizada em curto espaço de tempo para confirmação. Níveis entre 6,0 e 6,5% têm risco aumentado para a doença e devem ser acompanhados de perto além de incentivados à realizar mudanças nos hábitos e tentar perder peso.

Mas e o Sêo Apolônio? Como fica? Podemos aplicar o que sabemos agora e descobrir se ele tem ou não diabetes. Se desenvolvermos a fórmula acima, com uma GME de 123, obteremos o valor de 5,92% para a HbA1c (que eu propositalmente ocultei desde o início do texto – outra risada maligna). Conclusão, Sêo Apolônio ainda não está diabético, mas o susto vai ser muito, muito bem aproveitado, podem ter certeza…

Transplante de Fezes

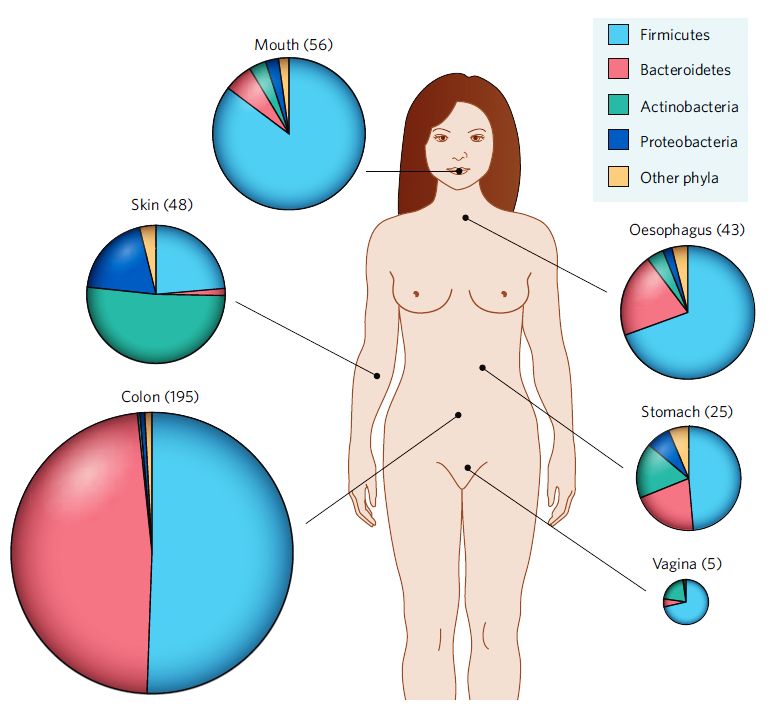

Parece* que nascemos mesmo livres, ao menos dos germes. Estéreis ou, como os cientistas gostam de dizer, gnotobióticos. Logo após o nascimento, entretanto, no período neonatal, somos já colonizados. O tipo de colonização é bastante influenciado pelo contato materno mas é, sob alguns aspectos, uniforme. Há mais de cinquenta filotipos de bactérias mas apenas quatro nos adotaram como lar. São eles os Firmicutes, os Bacteroidetes, as Actinobacterias e as Proteobacterias (parece Game of Thrones, né?). Mas, por que só quatro? Essa especificidade sugere uma interação de poderosas forças seletivas que permitiram eliminar algumas e manter outras espécies em co-evolução.

Fig. 1 – Esquema de distribuição dos filos bacterianos em um ser humano saudável. A área de cada setor do gráfico está relacionada ao número de diferentes espécies bactérias do filo no determinado sítio do hospedeiro. (copiado com permissão do Meio de Cultura)

Apesar de seguirmos esse padrão geral, cada ser humano parece ter uma combinação própria de bactérias desses filos, tornando a microbiota quase uma assinatura microbiológica de cada pessoa. As regras que governam a co-existência de humanos e bactérias de acordo com esse modelo ainda não são bem elucidadas, mas o fato é que alguns estudos em animais de laboratório gnotobióticos mostraram que tais bactérias não são fundamentais para o desenvolvimento normal desses bichos. Por outro lado, a gnotobiose não ocorre de forma espontânea na natureza. Então, parece realmente que obtemos alguma vantagem de nos deixar ocupar. No nosso caso específico, a microbiota que nos habita facilita a incorporação de vitaminas e nutrientes, ajuda no desenvolvimento e manutenção da integridade dos tecidos, em especial da mucosa intestinal, além de estimular em muitos aspectos as defesas contra invasores causadores de doenças, para citar alguns exemplos. Um desses invasores tem tirado o sono de médicos e microbiologistas: o Clostridium difficile. Vamos conhecê-lo mais de perto.

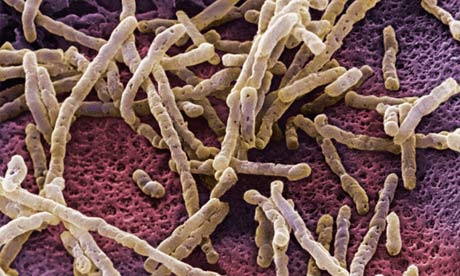

Fig. 2 – Fotografia de microscopia de população de Clostridium difficile no intestino sem microbiota nativa. (Copiado do The Guardian Foto de Dr David Phillips/Getty Images). Clique na foto para ver o original.

O Clostridium difficile é um bacilo (forma de bastão) anaeróbio obrigatório (não utiliza oxigênio), gram-positivo, que faz parte da microbiota intestinal e produz duas toxinas (A e B). A toxina A é uma enterotoxina que causa aumento da permeabilidade intestinal e secreção de fluidos, enquanto a toxina B é uma citotoxina que causa intensa inflamação dos cólons. Por isso, o clostrídio causa uma colite que chamamos de pseudomembranosa devido ao seu aspecto macroscópico à colonoscopia. O Clostridium difficile pode provocar até 20% dos casos de diarreia associada a antibióticos e é uma das causas mais comuns de diarreia adquirida em hospitais, em geral, em pacientes já debilitados o que além de dificultar o tratamento, aumenta o número de complicações. O tratamento para a colite por C. difficile consiste na administração oral de antibióticos (metronidazol ou vancomicina). Além disso, a taxa de recidivas é muito alta (15 a 26% dos pacientes). Nenhum tratamento efetivo contra as recorrências está disponível e o que temos é a prescrição de vancomicina prolongadamente. Isso, além de diminuir progressivamente sua eficácia, pode também ser a causa do problema. O que fazer?

Foi quando alguém teve a brilhante ideia que dá título a esse texto.

Ora, se o problema é um desbalanço na microbiota intestinal, vamos tentar restabelecê-la. Inicialmente, foram tentadas bactérias como os próbióticos (lactobacilos, etc). Não deu certo. Quando se tem pacientes morrendo e não se dispõe de terapias adequadas, a necessidade cria alternativas, muitas vezes desesperadas ou mesmo inusitadas.

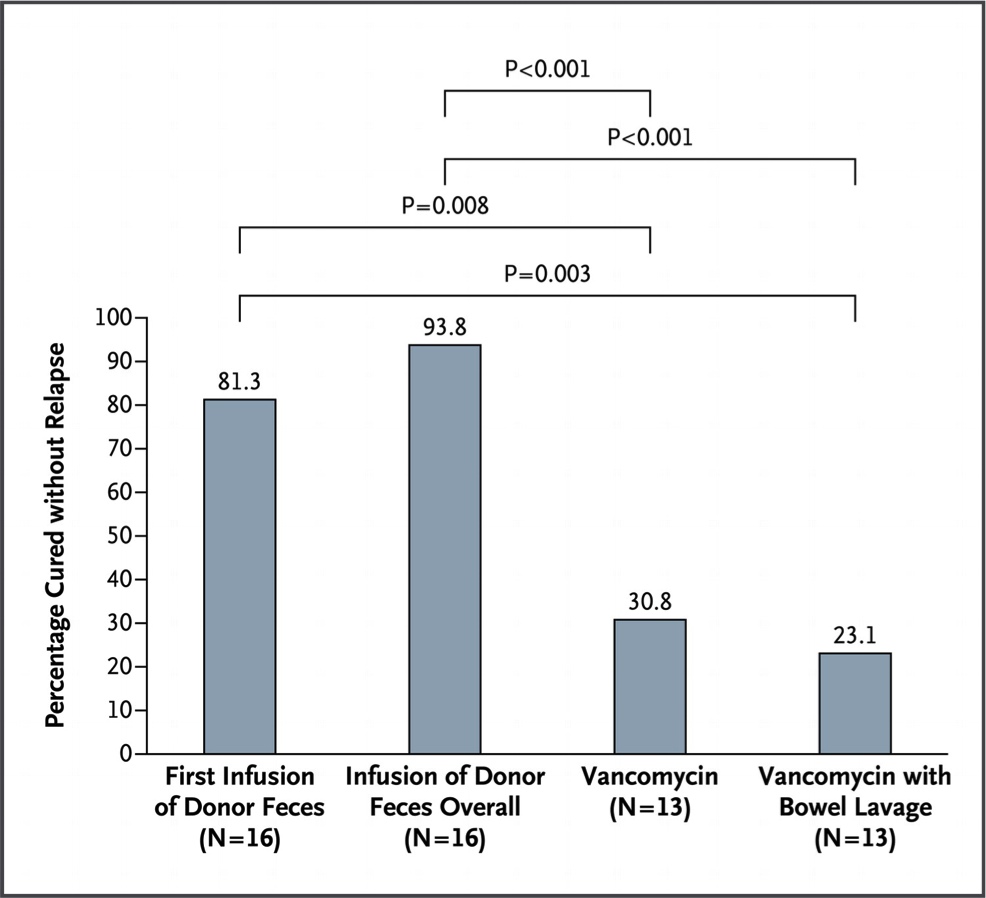

“Por que não passamos as bactérias de um indivíduo saudável para um doente?” – pensou algum médico desesperado. “Sim. Mas como faremos isso?” – respondeu seu amigo pragmático. “Ora, infundimos um lavado de fezes do intestino do saudável para o doente… Simples!”. Foi o que fez o grupo de pesquisadores holandeses liderados por Els van Nood, citados abaixo. Por mais nojento que possa parecer, a coisa funcionou. E muito bem. O estudo teve que ser interrompido em sua análise interina pois, com apenas 43 pacientes randomizados, foi possível demonstrar uma nítida melhora no grupo tratamento com 16 pacientes. Qual tratamento? O intestino dos indivíduos com clostrídio era lavado e após isso, infundia-se, por meio de uma sonda nasogástrica, 500 ml de solução constituída de material fecal de um doador saudável (ver metodologia original no final do texto). Paralelamente a isso, foi tentado o tratamento convencional com vancomicina e ainda, uma mistura dos dois. A figura 3 mostra a taxa de cura de cada tratamento.

Fig. 3. Gráfico mostrando a taxa de cura de acordo com os tratamentos instituídos com as respectivas significâncias (p) de cada grupo comparado com os outros. Para mais explicações, ver o texto.

O primeiro grupo, representado na coluna mais a esquerda, mostra a taxa de cura com uma infusão única. Se isso não resolvesse, era tentada uma nova infusão com fezes de um doador diferente. Esses resultados são agrupados na segunda coluna do gráfico da figura 3. A vancomicina sozinha ou associada às infusões parece realmente ser inferior. Interessante também avaliar a diversidade da microbiota dos pacientes após as infusões.

Fig. 4. Gráfico mostrando a variação da microbiota intestinal nos pacientes antes e após a infusão de fezes, comparando com os doadores de acordo com o índice de recíproco de Simpson. Para mais explicações, ver o texto.

A microbiota intestinal foi avaliada por análise de DNA usando microarray filogenético (Human Intestinal Tract Chip – HITChip) e a diversidade das comunidades bacterianas antes e depois da infusão de fezes usando uma escala chamada de Simpson’s Reciprocal Index of Diversity, que vai de 1 a 250, com os maiores valores indicando maior diversidade. É nítida a mudança após a infusão, ficando os pacientes com uma microbiota tão diversa quanto a dos doadores.

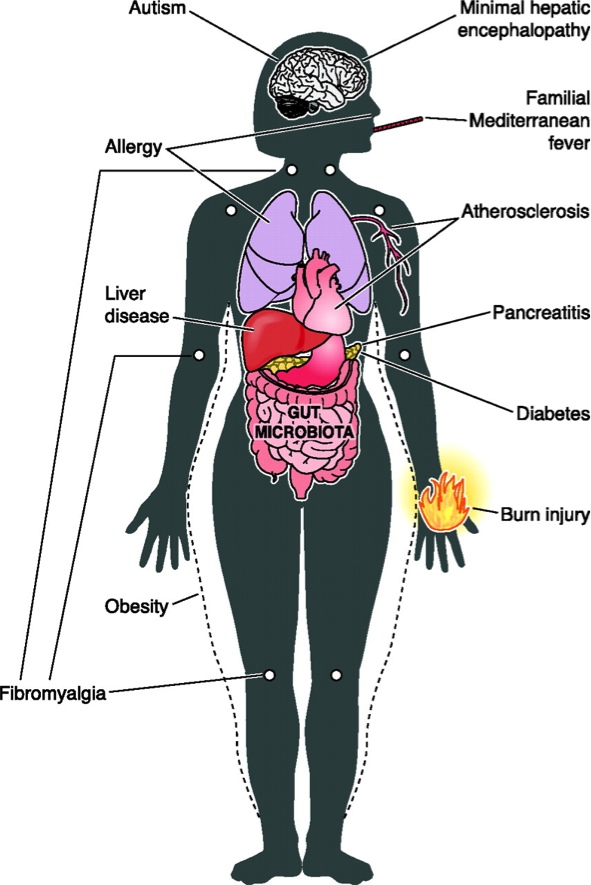

A conclusão é que o tal transplante de fezes funciona para o tratamento de infecções recorrentes pelo Clostridium difficile. Dito isto, podemos começar a imaginar algumas coisas. Muitas afecções atuais, que vão desde a obesidade até doenças cardíacas passando por fibromialgia, pancreatite e autismo, estão sendo atribuídas a alterações da microbiota (figura 5).

Fig. 5 – Esquema de possiveis doenças e/ou complicações associadas a alterações da microbiota intestinal. Clique na foto para ver o original.

Será que os futuros tratamentos vão ser…? Sei lá. Melhor nem pensar… Espero que alguém imagine uma cápsula deglutível que nos traga colonizadores saudáveis e nos livre de tais procedimentos pouco aprazíveis. Seria o caso de instituirmos um tipo de microhiperneocolonialismo do bem? Sim, porque a abordagem convencional de partir pra porrada e dar “veneno” para as bactérias, dividindo-as entre boas e más, parece não surtir mais efeito (como em tudo, aliás).

*Atualizado em 23/06/2013

Referências

Blaser, M., & Falkow, S. (2009). What are the consequences of the disappearing human microbiota? Nature Reviews Microbiology, 7 (12), 887-894 DOI: 10.1038/nrmicro2245

van Nood, E., Vrieze, A., Nieuwdorp, M., Fuentes, S., Zoetendal, E., de Vos, W., Visser, C., Kuijper, E., Bartelsman, J., Tijssen, J., Speelman, P., Dijkgraaf, M., & Keller, J. (2013). Duodenal Infusion of Donor Feces for Recurrent New England Journal of Medicine, 368 (5), 407-415 DOI:10.1056/NEJMoa1205037

Apêndice

Infusion of Donor Feces – methodology

Donors (>60 years of age) were volunteers who were initially screened using a questionnaire addressing risk factors for potentially transmissible diseases. Donor feces were screened for parasites (including Blastocystis hominis and Dientamoeba fragilis), C. difficile, and enteropathogenic bacteria. Blood was screened for antibodies to HIV; human T-cell lymphotropic virus types 1 and 2; hepatitis A, B, and C; cytomegalovirus; Epstein–Barr virus; Treponema pallidum; Strongyloides stercoralis; and Entamoeba histolytica. A donor pool was created, and screening was repeated every 4 months. Before donation, another questionnaire was used to screen for recent illnesses.

Feces were collected by the donor on the day of infusion and immediately transported to the hospital. Feces were diluted with 500 ml of sterile saline (0.9%). This solution was stirred, and the supernatant strained and poured in a sterile bottle. Within 6 hours after collection of feces by the donor, the solution was infused through a nasoduodenal tube (2 to 3 minutes per 50 ml). The tube was removed 30 minutes after the infusion, and patients were monitored for 2 hours. For patients who had been admitted at referring hospitals, the donor-feces solution was produced at the study center and immediately transported and infused by a study physician.

Razão de Chances

Outro dia, me perguntaram a tradução para o português brasileiro do termo estatístico odds ratio. Acho que a mais utilizada é mesmo razão de chances. Essa nomenclatura tem um significado muito especial porque chance é uma forma de exprimir probabilidade. Probabilidade, por sua vez, pode ser a medida de uma incerteza ou de uma expectativa de ocorrência acerca de um evento. É interessante separar essas duas formas de probabilidade porque delas se originam os dois ramos principais do pensamento probabilístico, a saber, “probabilidade tipo crença” e “probabilidade tipo frequência”, respectivamente [1]. Outros autores usarão os termos “subjetiva” e “objetiva”, “epistêmica” e “aleatória” e, finalmente, “bayesiana” e “frequentista”, respectivamente. Em medicina, usamos muito a frequentista apesar de que abordagens “subjetivas” têm sido cada vez mais frequentes, hehe. (Sorry, pelo trocadilho infeliz, ver aqui e aqui, pitacos recentes sobre Bayes).

Risco, chance e probabilidade são conceitos dos quais temos noções intuitivas e que, muitas vezes, utilizamos indistintamente. Mas há diferenças importantes. Diferenças que devem ser conhecidas tanto por quem reporta os dados, como para quem lê um artigo científico que os usa. Imagine a seguinte situação retirada do livro do professor Júlio César [1]. Foram analisadas 793 quedas de moto em determinada cidade. Alguns motoqueiros estavam de capacete, outros não. Alguns sofreram ferimentos na cabeça e outros não. Podemos usar a tabela abaixo, para melhor visualizar os dados.

|

Uso de Capacete |

Total |

|||

|

Não |

Sim |

|||

| Ferimento na Cabeça |

Não |

428 |

130 |

558 |

|

Sim |

218 |

17 |

235 |

|

| %Ferimento na Cabeça |

33,75% (218/646) |

11,56% (17/147) |

29,63% (235/793) |

|

| Total |

646 |

147 |

793 |

|

Por esses dados podemos concluir que a probabilidade de motoqueiros terem ferimento na cabeça após uma queda nesta cidade é 29,63%. Já a probabilidade de um ferimento na cabeça com capacete é de apenas 11,56% e sem ele é de 33,75%. Esses números se referem ao conjunto dos acidentados. Pacientes gostam de perguntas do tipo: “Dr, qual o risco de EU machucar a cabeça se EU andar de moto sem capacete?” Uma resposta possível seria: “Segundo um estudo, ao andar de moto em determinada cidade sem capacete, o risco de se lesionar a cabeça em um acidente é 33,75%”. Risco, portanto, seria a própria probabilidade trazida ao nível individual. Aí, a pessoa que fez o estudo fica famosa e vai dar uma entrevista ao jornal local. Lá pelas tantas, a repórter gata pergunta: “Muito bem, doutor, sabemos que o capacete protege contra lesões encefálicas. Mas, quanto?” Você pode fazer a seguinte conta 33,75%-11,56% = 22,19% e dizer que há uma redução de 22% no risco. A repórter: “???”. Você vendo o desespero dela e querendo ajudá-la (e aproveitando para se exibir um pouco), mentalmente, faz outra conta 33,75/11,56; e ao vivo, responde na lata: 2,92. O que quer dizer esse número? Quer dizer que o número de lesões encefálicas em quem se acidenta de motocicleta e não usa capacete é quase 3 vezes maior (2,92) que em quem usa. Esse é o que chamamos Risco Relativo (RR). Fica bem mais fácil de entender, não? (Você poderia ainda fazer outra conta que é 1/22,19% = 4,5, que significa que para cada 4,5 motoqueiros usando capacete que caem, você previne 1 lesão encefálica. Esse é o number need to treat – NNT – muito utilizado em ensaios clínicos, mas aí a repórter ia se apaixonar). Quem usa capacete tem menos risco de lesão encefálica, associação agora devidamente quantificada. O RR é um número muito fácil de compreender e por isso é muito bom quando podemos informá-lo. A odds ratio (OR) e o risco relativo (RR) são semelhantes e as duas medidas de associação mais utilizadas em epidemiologia. Por essa razão, são extremamente importantes para as ciências da saúde, em geral, e para a medicina, em particular.

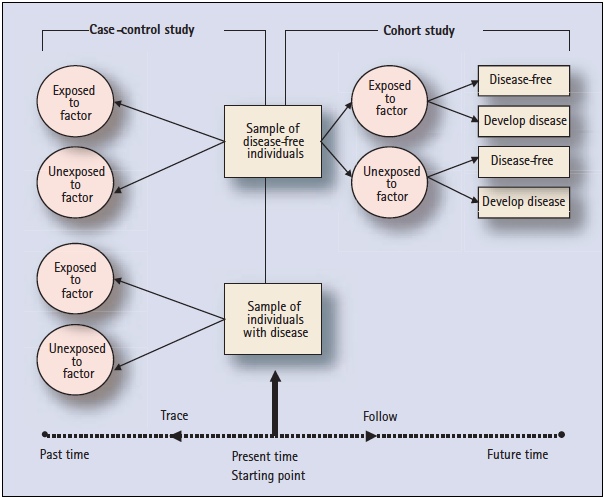

Chamemos de associações, as inferências sobre relações causais, mas usemos outro exemplo: Quem tem colesterol alto tem mais infarto do miocárdio? Estudos epidemiológicos tentam associar dislipidemia com eventos coronarianos. Como? De várias formas, mas especialmente com estudos chamados de observacionais porque os pesquisadores só ficam observando o que vai acontecer, sem intervir nos casos. (Estudos em que há uma ou mais intervenções são chamados, muito sugestivamente, de intervencionais ou experimentais). Voltando aos estudos observacionais, estes podem ser de dois tipos principais: transversais (cross-sectional) ou longitudinais. Os transversais são como uma foto de uma comunidade ou grupo de pacientes, ou seja, o tempo está parado e estático, não havendo seguimento dos indivíduos no tempo, portanto. São bons para avaliarmos a prevalência de doenças. Por outro lado, longitudinais são os estudos que requerem que os indivíduos sejam observados por um período de tempo. Esse “tempo” em que vou “observar” pode ser para frente ou para trás e aqui, por favor, não entre em pânico. Veja a figura abaixo (desgraçadamente em inglês, mas fácil de entender, retirada da referência [2])

É sempre bom começarmos do starting point. Notai que existem 2 caixas “contendo” indivíduos com uma determinada doença e sem ela. Se, para utilizarmos o exemplo acima, dosarmos o colesterol de todo mundo, saberemos quem tem dislipidemia (colesterol alto) e quem não tem, i.e., quem está ou não exposto ao fator que queremos estudar. Se eu seguir esses pacientes por um tempo, vou ver quem teve (develop disease) ou não (disease-free) infarto do miocárdio. E assim, terei feito um brilhante estudo de Coorte. Se, por outro lado, eu pegar os registros hospitalares, dos consultórios, ou quaisquer que sejam, de pacientes com infarto e comparar com pacientes que não tiveram infarto, posso tentar associar o colesterol elevado no passado com a presença de doença coronaria atual, retrospectivamente. Estarei então, fazendo um estudo caso-controle. Entendido isso, vejam só que interessante.

Em um estudo transversal (o da fotografia), eu posso calcular o risco de uma certa doença baseado na sua prevalência, ou seja, no número de pessoas com aquela doença naquele exato momento. Nos estudos de coorte (aqueles nos quais o tempo vai “pra frente”), eu posso obter o risco de desenvolvermos uma doença qualquer através da incidência. Ótimo, perfeito! Mas, e no estudos caso-controle? Como faço para obter o risco já que o tempo vai “pra trás”? Como vimos, o risco é a probabilidade de algo acontecer a nível individual. Se tivermos as incidências e prevalências de antemão, poderemos estimar o risco, mas isso nem sempre é possível ou é não confiável. Como diz o Luiz Cláudio do excelente MBE: “Quando o estudo é caso-controle, onde casos (desfecho já ocorreu) são selecionados no início do estudo de forma arbitrária, não dá para calcular a proporção de pacientes que virão a ter o desfecho. Ou eles já tiveram o desfecho (casos) ou eles não tiveram o desfecho (controle). Neste caso, como não dá para calcular probabilidade do evento ocorrer, se usa odds (chance)”.

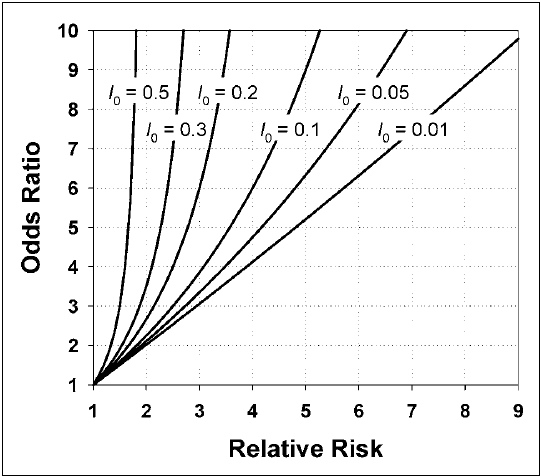

Posto isso, qual a diferença entre OR e RR? O raciocínio é mais ou menos o mesmo. Entretanto, as duas grandezas não podem ser utilizadas indistintamente. A OR superestima a RR na dependência da incidência da doença estudada. Veja o gráfico abaixo retirado da referência [3].

De novo, o Luiz Cláudio nos ajuda: “Um erro freqüente é a leitura do odds como se fosse risco. Odds ratio de 3.8 não quer dizer risco 3.8 vezes maior. Isso não é risco, pelos motivos já expostos. No entanto, quando o desfecho é raro, com uma freqüência menor que 10%, as medidas do OR e do RR se aproximam. Mas em um desfecho freqüente, embora as duas medidas indiquem um fenômeno na mesma direção, o OR tende a superestimar a força de associação, quando comparado ao RR.”

Quando a incidência é baixa (Io = 0,01) a correlação entre as duas variáveis é boa. Mas reparem na curva da Io = 0,3 (30%). Quando o RR é 2, a OR é próxima a 4, quase o dobro. A propósito, a OR dos motoqueiros com cabeça quebrada acima é 3,89 contra o RR que é 2,92, como vimos.

Fórmulas

RR = p / q

OR = p (1 – q) / q (1 – p)

Consultei

[1] Pereira, Júlio César R. Bioestatística em Outras Palavras. São Paulo. Ed USP, FAPESP. 2010.

[2] A. Petrie J. S. Bulman and J. F. Osborn. Further statistics in dentistry. Part 2: Research designs 2. British Dental Journal 2002; 193:435–440

[3] Carsten Oliver Schmidt, Thomas Kohlmann. Int J Public Health 53 (2008) 165–167

Ver também o excelente medicina baseada em evidências citado acima.

Abraço ao André Souza do Cognando, motivador do post.

Os Mestres do Preconceito

“Clínicos são intérpretes prudentes das experiências de saúde de seus pacientes”.

R.E.G. Upshur [1] (grifos meus)

Ao GENAM, com carinho

O esforço do Homem (antropos) para compreender o cipoal de significados sobre o qual é lançado no momento em que nasce é crucial para sua sobrevivência. Hoje, a infinidade de códigos e linguagens que devemos interpretar e traduzir para lidar com o mundo é gigantesca. A medicina, da forma como a entendo, qual seja, centrada na relação entre o médico e o paciente, propõe um desafio interessante porquanto aproxima duas visões de mundo, às vezes muito diferentes. Ao médico, cabe ainda um outro desafio que é o de aplicar o conhecimento científico – quase uma epistéme aristotélica – a uma prática fronética ou prudente, reconhecida desde sempre como técnica (techné), citando Aristóteles, o pai dessa zorra toda que, aliás, já tem alguns milênios.

O que tentarei demonstrar nesse pequeno espaço, seguindo os caminhos do autor abaixo [1], é que um pouquinho de preconceito é bom para o médico, tanto em sua tarefa de fundir sua visão de mundo àquela que o paciente vê, como quando lida com a massa enorme de conhecimento científico e tenta aplicá-la no ser que lhe pede socorro. Thomas Bayes (1701?-1761) e Hans-Georg Gadamer (1900-2002), cada um a seu tempo e a seu modo, trataram desse preconceito filosófico. Um obscuro monge inglês pertencente a uma seita não-conformista (seja lá o que isso realmente queira dizer) e um alemão, brilhante aluno do sacana do Martin Heidegger, nascidos com 200 anos de intervalo, teorizaram sobre o valor do preconceito, ou pré-conceito, ou pré-juízo (como no inglês, prejudice) no ato de compreensão humana das coisas do mundo. Eu os chamo mestres do preconceito.

Bayes

A Estatística pode ser entendida como a ciência que se ocupa da quantificação da incerteza e, por essa razão, o cálculo probabilístico ocupa um papel central nela. Há duas formas básicas de se abordar a probabilidade de um evento ocorrer. Um, chamado objetivo, é testar a ocorrência do evento em um número muito grande de vezes, de modo a estabelecer a frequência do resultado que se quer estudar. É chamado de frequentista. O outro leva em consideração a probabilidade desse evento ocorrer antes que procedamos ao teste. Poderíamos até pegar os dados de um frequentista que trabalhou duro para obtê-los e ter acesso a essa distribuição antes de testar o evento. Chamamos isso de probabilidade a priori. De posse dessa probabilidade a priori, podemos modificar nossas expectativas ao avaliar, por exemplo, o risco de uma paciente com mamografia positiva ter, de fato, câncer de mama [2]. O interessante é que, quando essa distribuição não está disponível, podemos colocar nossas próprias expectativas na fórmula. Para a estatística bayesiana vale a opinião pessoal sobre o evento, vale a nossa propensão em acreditar na distribuição a priori, por isso, também é chamada de subjetiva. A nós, interessa a origem dos a prioris clínicos. Há evidências de que clínicos utilizamos a experiência prévia muito mais que dados estatísticos consistentes [3]. De qualquer forma, o teorema de Bayes permite que reajustemos o grau de crença em uma hipótese com base em novas informações. Ou em outras palavras, nossas preconcepções, sejam diagnósticas, prognósticas ou terapêuticas, devem ser reavaliadas a cada novo dado, cotejadas com novas evidências e, por fim, modificadas em novas possibilidades.

Gadamer

Em 1960, Gadamer publica Verdade e Método, seu magnum opus, onde reforça a característica ontológica da compreensão humana, ou como ficou conhecida mundialmente, da hermenêutica filosófica. “Compreender não é um ideal resignado da experiência de vida humana na idade avançada do espírito, como em Dilthey; mas tampouco é, como em Husserl, um ideal metodológico último da filosofia frente à ingenuidade do ir vivendo. É, ao contrário, a forma originária de realização da pre-sença, que é ser-no-mundo”- diz ele lá na página 347 [4] (itálicos originais). Gadamer demonstra que a interpretação e a compreensão são constitutivos do homem lançado ao mundo. Nessa demonstração, o pré-conceito tem um papel fundamental. Quando interpretamos um texto, realizamos, na linguagem de Gadamer, um projeto. Como nessa citação:

“é preciso (…) considerar que cada revisão do projeto inicial comporta a possibilidade de esboçar novo projeto de sentido; que projetos contrastantes podem se entrelaçar em uma elaboração que, no fim, leve à visão mais clara da unidade do significado; que a interpretação começa com pré-conceitos que são, pouco a pouco, substituídos por conceitos mais adequados. (…) Aqui, a única objetividade é a confirmação que uma pré-suposição pode receber através da elaboração. E o que distingue as pré-suposições inadequadas senão o fato de que, desenvolvendo-se, elas se revelam insubsistentes? (…) Há, portanto, um sentido positivo em dizer que o intérprete não chega ao texto simplesmente permanecendo na moldura das pré-suposições já presentes nele, mas muito mais quando, em relação com o texto, põe à prova a legitimidade, isto é, a origem e a validade, de tais pressuposições”. [5]

A aproximação inicial a um assunto provoca uma impressão que nos impele emitir juízos que definem padrões lógicos ou generalizações em nosso esforço eterno de tentar prever comportamentos, sequências ou comparar coisas novas com aquelas que já conhecemos. Essa primeira impressão não é a que fica. Ela deve ser continuamente corrigida à luz de novas informações. Os a prioris bayesianos e os projetos hermenêuticos estão muito mais próximos do que poderíamos jamais supor. Eles têm valor ontológico ou, em outras palavras, são criadores de conhecimento válido. Na medicina, essa proximidade sempre foi patente; só não tinha nome. Como diz Upshur “a dimensão hermenêutica da medicina desvia nossa atenção de discussões sobre dicotomias simplistas tais como se a medicina é uma arte ou uma ciência; ou se o conhecimento clínico é subjetivo”. A medicina é um humanismo. A doença tira o Homem de sua unidade habitual e abre caminho para visões não-totalizantes de seus padecimentos. O que é, então, o esforço clínico em compreender o Homem em suas profundidade espiritual e complexidade biológica? Nesse contexto, Arte e Ciência são interpretações, discursos possíveis sobre uma mesma coisa-em-si humana. Subjetivos? É óbvio que somos; dado que sempre tratamos de individuais subjeitos.

[1] Upshur, REG. Prior and Prejudice. Theoretical Medicine and Bioethics 20: 319–327, 1999.

[2] Pena, SD. Thomas Bayes “é o cara”. CIÊNCIA HOJE • vol. 38 • nº 228, pg 22-29 – Julho/2006 (ver o pdf)

[3] Gill CJ, Sabin L, Schmid CH. Why clinicians are natural bayesians. BMJ. 2005 May 7;330(7499):1080–3. DOI: 10.1136/bmj.330.7499.1080 (Open Access) – veja também as cartas, correções e comentários.

[4] Gadamer HG. Verdade e Método. II Parte, Volume I. Editora Vozes. Tradução Flávio Paulo Meurer.

[5] Reale & Antiseri. Hans-Georg Gadamer e a Teoria Hermenêutica. in História da Filosofia, pag 627-639.

PS. A conotação extremamente negativa que temos hoje do preconceito vem do Esclarecimento. Para o homem iluminista, cartesiano, um juízo acerca de alguma coisa deve ser tomado de forma isenta e desprovida de qualquer pré-concepção a respeito do assunto. Como uma tabula rasa, deveríamos absorver as evidências e chegar a conclusões óbvias, conclusões as quais qualquer pessoa racional chegaria ao analisar as mesmas provas. No Esclarecimento, o objetivo é o projeto cartesiano de obter um conhecimento metodologicamente seguro, limpo de interferências e inferências pessoais. Posteriormente, essa pre-concepção das coisas adquiriu um valor moral – como no pecado de “julgar um livro pela capa” -, até incorporar temas diversos como racismo, xenofobia, diversidade cultural, sexual e etc.

UTI. Uma boa referência às virtudes de Aristóteles, além claro, do “Ética a Nicômaco” é o livro de Enrico Berti “As Razões de Aristóteles“.

Um Bisturi de Argônio – Carta ao Professor de Clínica Médica

O saber não é para compreender. O saber é para cortar.

Michel Foucault

Professor,

Não sem muita hesitação resolvi sentar à frente desta tela e datilografar (sim, tenho diploma de datilografia, o que dá uma ideia da minha geração) estas reflexivas linhas. A idade e uma distância mantida cuidadosamente estável para que não se perca de vista os ares e paisagens acadêmicos, me fizeram crítico e, porque não dizer, algo ranzinza das coisas da medicina. A distância, na verdade, se articula com o tempo que a idade fez passar, e dota meu olhar com um bisturi de argônio existencial: ao mesmo tempo que espicaça fatos, coagula emoções. Sendo assim, espero que me perdoe alguma indelicadeza e/ou imprecisão no que segue. Mas é que eu tinha que falar…

Outro dia, um professor de cirurgia da faculdade me perguntou incisivamente: “Quem é o CLÍNICO deste hospital? Quem é o CLÍNICO desta cidade?” Fiquei pensando na resposta e, como sói acontecer com as perguntas em que não encontramos a anestesia de uma certeza, estou nela pensando inda agora. E dói esse pensamento. Lembremos da nobre origem da clínica médica no século XIX, na França, mais especificamente, em Paris, tendo como exemplo uma nova forma de atuar de alguns médicos do Allgemeine Krankenhaus em Viena (figura), da Escola de Medicina de Edimburgo entre outras, que, somada à mudanças epistemológicas na ciência médica, com a recém-constituída Anatomia Patológica incluída no raciocínio clínico, “colou” o nome à coisa e abriu caminho para uma medicina positiva.

À partir daí, os clínicos gerais ganharam prestígio como médicos, e calaram Moliére. Sua atividade, dividida entre o hospital e o consultório, permitia que acompanhassem uma variedade muito grande de pacientes com doenças em suas múltiplas manifestações e diversos graus de gravidade, fazendo com que ganhassem grande erudição médica dentro, obviamente, da ciência possível em cada época. O clínico geral era um sábio.

Eis que se muda novamente a episteme, como diria Foucault. Mudam os “códigos fundamentais de uma cultura” e a ordem do discurso, por conseguinte. O clínico geral – e os especialistas da Clínica Médica – passa então, cada vez mais, a ser um tipo de porta-voz de uma ciência avassaladora na qual a “medicina baseada em evidências“, para além de ferramenta cotidiana, transforma-se em imperativo ético, em um subproduto ideológico. Os cirurgiões não sofreram na carne o golpe com a mesma intensidade. Para eles há ainda o ato cirúrgico que depende de uma habilidade, uma arte, um dom e que, de uma certa forma, os blinda da “invasão de privacidade” – na relação entre ele e seu paciente e que funda a medicina -, da ciência enxerida e abelhuda, vista como um fim e não como meio de praticar medicina. A Clínica Médica sofreu ainda um outro golpe. A especialização crescente que o conhecimento técnico exige não nos dá muitas opções: doenças sistêmicas? doenças comuns? diagnósticos difíceis? O que é e em qual área da medicina atua um clínico geral moderno? Responder que nossa especialidade é o “doente” e não as doenças, não parece ser suficiente. Os hospitais mudaram. Ninguém quer ficar internado muito tempo e as fontes pagadoras pressionam para manter os pacientes fora dos hospitais. Alguns buscaram aprender algum “procedimento”. As especialidades médicas que assim o permitiam ganharam novo fôlego. Cardiologistas passaram a dominar técnicas percutâneas de diagnóstico e tratamento, ecocardiografia e outras atividades mediadas por máquinas. Gastroenterologistas e pneumologistas, aprenderam a endoscopar e biopsiar. Reumatologistas, hematologistas e oncologistas começaram a prescrever “drogas perigosas” que somente eles podem prescrever. E assim, toda a Clínica Médica foi se “ajeitando” dentro da nova episteme; se recriando à luz das necessidades; adquirindo novas habilidades e novos discursos. Ao buscar uma arte, uma habilidade, um procedimento, ao mesmo tempo em que se defendem de intrusões indesejadas e resguardam sua aura de técnico à moda dos cirurgiões, também procuram obedecer a lógica de mercado e

atender às solicitações da sociedade em busca da inovação e das novas tecnologias. Talvez o protótipo do clínico geral moderno, que vê o paciente como um todo, tendo como pano de fundo uma Matrix de dados virtuais e ainda realizando procedimentos característicos da especialidade, seja o médico que trabalha em unidades de terapia intensiva: o intensivista. Hoje, parece que o intensivista permanece ainda com algum resquício da fleuma do clínico geral de outrora. Mas, também ele, passa o plantão.

Foi assim então, que o clínico, perdeu sua Palavra. E as alunos começaram a perguntar: “que adianta ser um médico mudo?”

Alguém poderia pensar entretanto, que o clínico não é necessário. Que sua sabedoria totalizante não teria lugar no mundo da velocidade, do procedimento, da hiperespecialização, da virtualização dos corpos. Que ele logo ficaria desatualizado, ultrapassado pelo vagalhão feroz de ciência médica produzido diariamente por milhares de jornais científicos ao redor do mundo. “Não dá” – dizem os próprios médicos a si e aos colegas. Mas, para estupefação testemunhada diariamente de alguns, os próprios pacientes, entre eles alguns médicos que, pasme, também ficam doentes, requisitam os serviços do clínico. Por quê?

Eu tive bastante contato com um professor de patologia cuja vida foi dedicada a estudar o fígado e o pâncreas. Ironia do destino, teve o diagnóstico de câncer de pâncreas agressivo. Já bem magro e cansado de terapias de pouco efeito, embora pleno de seu raciocínio claro e agudo, me confessou que os médicos ficavam um pouco intimidados por ele ser uma autoridade mundial na doença que o consumia. A gota d’água foi o fato dele mesmo ter que comunicar à família (esposa e filhos) seu diagnóstico, além de discutir o prognóstico. “Nunca”- me disse, sem carregar nas emoções – “me faltaram bons médicos. Sempre me trataram com muito carinho e respeito onde quer que eu fosse. Mas me faltou UM médico.”

Foi imerso nas profundezas dessas memórias – e é incrível como com o chegar da idade, as memórias formam cada vez mais nossos pensamentos – que li que um professor de Clínica Médica ministrava um curso sobre os Fundamentos da Homeopatia.

“Homeopatizar” a Clínica Geral me parece um caminho que, se por um lado, valoriza a avaliação do ser humano como um todo (não usarei “abordagem holística” aqui dada a contaminação desta expressão com outros tipos de charlatanismo) que é o que fazemos, por outro, fere a própria origem da clínica, calcada profundamente em conhecimentos científicos válidos. Se essa abordagem – a científica – nos trouxe para o imperialismo cientificista da prática médica contemporânea, outras formas de “ver” o paciente devem ser procuradas. Não somos cientistas e não somos curandeiros. Somos médicos e isso já é ser duplo, tal como os “humanos” de Aristófanes no Banquete. Mutilados que fomos, nossa metade científica nos transforma em autômatos repetidores de “evidências”. O vazio existencial que fica nos impele a procurar a metade oposta – humana – e ela NÃO está nas alternativas à medicina! Pelo contrário, está nela própria, professor. E para encontrá-la talvez seja necessário reduzir fenomenologicamente a medicina ao seu núcleo duro, dissecá-la até que surja o encontro que a define: a relação médico-paciente. E “histologicamente” do que é tal relação constituída? Alguma pista? Sim. Ela é feita de linguagem! Nada mais humano e a um só tempo, científico. Para chegar a isso, talvez seja mesmo necessário um metafísico bisturi de argônio. Posso emprestar o meu, existencial, que consegui na distância e no tempo. Porque, creia, o senhor vai precisar.